🔆一文看懂 @Mira_Network :打造可信任的验证层

一句话说清楚:Mira是帮 AI 输出“验明正身”的项目,确保 AI 说的是真的。

我们都知道现在 AI 很厉害,但有时候它说话也挺“离谱”的,比如一本正经胡说八道,自己都不自洽。Mira 想解决的就是这个问题——让 AI 的回答不只是“能说”,还要“说得对”。

1⃣.为啥我们需要“验证 AI”?

现在无论是用 ChatGPT 查资料,还是让 AI 写报告、生成法律或医疗建议,都会面临一个问题:你怎么知道它说的是不是真的?

别小看这个问题,如果 AI 给出的是错的,有些后果可能挺严重的。比如生成假数据、自己逻辑都不通……如果我们直接拿这些“幻觉”去决策,比如医疗、法律、金融场景,后果可能很严重。

Mira 就是来做“AI 的审稿人”的,确保它每句话都有人查、有依据、有验证。

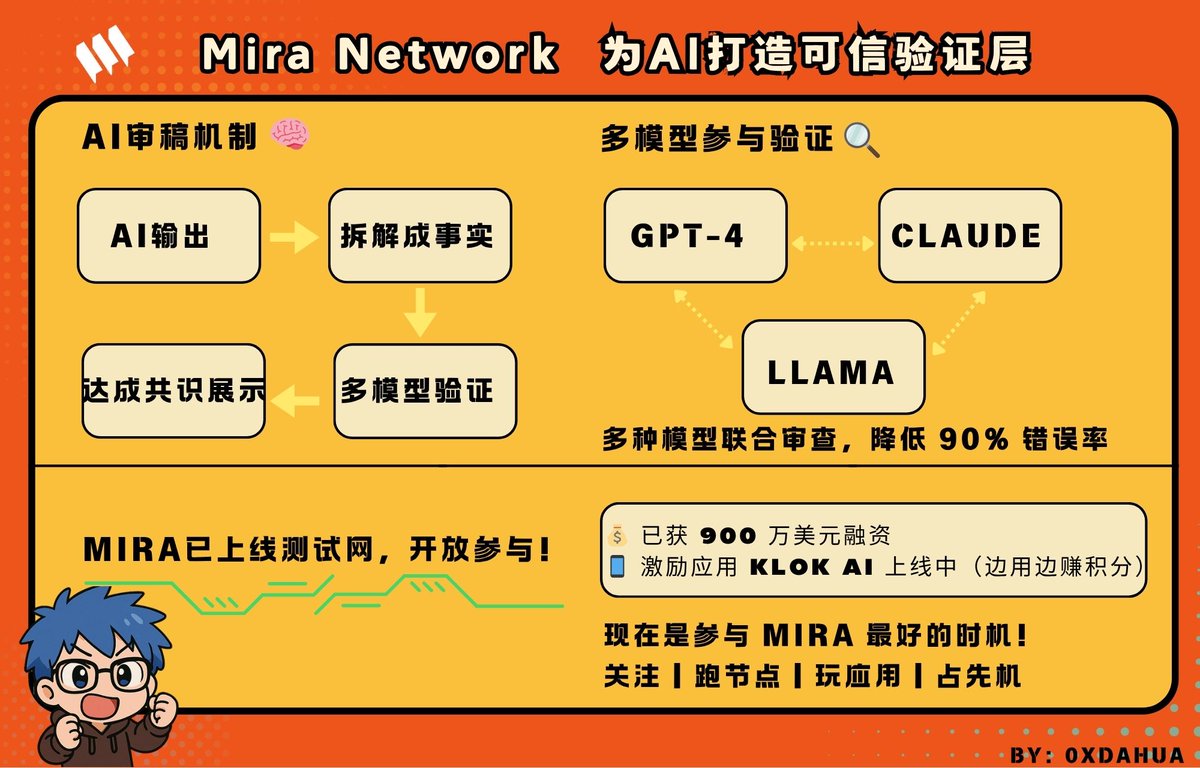

它的逻辑其实蛮简单的,但很实用:

先把 AI 的回答拆分成一条条“事实”—— 像查论文一样,不是整段忽悠,而是逐条过一遍。

交给多个 AI 或节点来验证这些事实—— 不依赖单个 AI,而是 GPT-4o、Claude、LLaMA 等多个 AI “组队审核”。

共识通过后才展示给用户——大家都觉得“没问题”后,才输出最终结果。

这种机制就像是开会审核内容,避免一个模型“脑抽”导致你看了假消息。

2⃣.那它到底是什么系统?

Mira 搭了个自己的测试网,还有开放 API 给开发者用。主要可以干这几件事:

你可以把 AI 的回答丢过去,它来帮你验证;

你也可以直接用它生成内容,它会自动带验证;

甚至可以拿自己的 AI 模型接进来一起参与验证。

目前兼容的大模型包括 GPT-4、Claude 3、Mistral 等等。

👉 实测下来,它能把错误率降低 90% 以上,速度也很快。

3⃣那节点、验证者怎么激励?

Mira 是 Web3 项目,所以有自己的代币机制和验证激励模型:

想当验证者要质押代币,乱来会被罚;

验证内容是有奖励的,谁做得好谁拿币;

验证结果会上链,大家都能查,防止造假。

简单来说就是:认真验证有钱赚,瞎搞就罚钱,一切都公开透明

目前Mira已经上线测试网,可以跑节点,也能接 API。并且拿到了 900 万美元融资,投资方包括 BITKRAFT、Framework、Accel 等。已经和不少项目合作,像 Gaianet_AI、OpenLedger、https://t.co/9Wf3eSEO6n、Spheron 等都有互动。

现在 Mira 也在推自己的激励应用 Klok AI,用户可以边用 AI 边赚积分。

总的来说,Mira Network 就是想做一个AI 世界的“真相守门人”,让每一句 AI 输出都经得起推敲。用区块链+去中心化的方式做“AI 质检员”。

现在无论是参与节点、0撸、嘴撸、关注生态’都有机会赶上这波风口。

From X

Disclaimer: The above content reflects only the author's opinion and does not represent any stance of CoinNX, nor does it constitute any investment advice related to CoinNX.