在龙虾爆火后,我越来越相信在不久的将来,各类AI Agent会替代它的主人,活跃在网络上进行交流、交易信息、购物等等行为。

而其中最最基础的一个,那就是支付。而AI Agent世界的支付,需要满足

1)足够快,能支持高频的交易转账

2)极低的手续费的支持微小金额转账(甚至是0.0001刀以下)

3)无国界

很明显,能满足上面条件的只有区块链。在Agent时代,区块链和AI真的是绝配。

看到肖老板刚发布的HSK 白皮书2.0,很明显也是主打的这个点。为Agent提供一个完善的支付网络,是web3最有前景的方向。

除了前面说的几个优先,我发现肖老板还考虑的更深,Hashkey Chain 还使用零知识证明,可以让Agent有一个合规数字身份证,它不仅有隐私保护的功能。更重要的,能解决一大部分安全的问题。杜绝了高资产的Agent被坏人跟踪惦记。

Hashkey Chain还设计了机构级许可链,利用其合规的优势,它可以作为结算的主链,而机构可以构建执行层,实现每秒百万笔的吞吐。

Anyway,AI并不是抢了区块链的风头,而是更需要区块链了,这个方向越来越有意思了。

Codex编程能力非常牛,但是它最令人头疼的是:给出的回答里有一堆专业术语,看都看不懂。

之前我的做法是把它拷贝给另外一个ai,让它解释一下。

这两天突然想到,其实可以做一个skill,直接让gpt5.4说人话。

它会直接把刚才回答改写成更简单、适合初学者看的中文说明。

特别是碰到分析出的问题的时候,会根据下面的格式

问题:就像门卫只看了通行证上的名字,却没有检查印章是不是真的。

原因:代码里用了 jwt.decode(),这个方法只会把通行证上的内容读出来,不会检查印章真伪。

后果:任何人只要随便伪造一张通行证,就能冒充别的用户登录。

修复建议:把 jwt.decode() 换成 jwt.verify(),这个方法会同时检查印章,是假的就会直接拒绝。

具体skill已经开源

https://t.co/rzEWskUnPa

现在的ai面对复杂的项目,依然会有bug。而且局部改bug经常会越改越麻烦。

其实,我一直采用一招最最简单的方法:就是重复3遍的方法。

很多人会写subagent、skills,或者superpower、oh-my-claude等复杂项目。但是我感觉下来,依然不如重复3遍简来的简单方便。

做法很简单,当ai完成任务后,你就说,让ai根据要求审核一下代码。根据我的经验:

第一遍,ai会找到好几个问题,你无脑让它修改就好。

第二遍,ai会找到好几个问题,你需要大致看一眼,让它修改严重的。

第三遍,需要特别注意的地方到了。 ai每次都会找一些问题,有些问题压根不重要。所以,这个时候你需要请另外一个ai来审核一下。

比如codex编码的,可以让claude code审核。反之亦然。

基本上第三遍让第二个ai对问题评价出,都是小问题。那你就可以停止了。如果还有一些严重的问题,那还可以继续审查。

我用下来的结果,在过去几个月来,到了项目运行阶段没有碰到过要修复代码的情况了。

在这种最质朴的方法实践多次,我也明白了

1)即使是最好的编程ai,比如codex或者搭配opus的claude code,写复杂项目的时候依然会出现bug

2)即使是最好的编程ai,也会没事找事的找到新的bug。

便宜的中转站,往往才是最贵的坑——我踩过之后,总结了3个辨别真假的工具

因为封号的原因,中转站已经成为唯一的选择的。但是,现在市面的中转站鱼龙混杂,良莠不齐。

今天,我分享几个评价中转站的评测

1 helpaio

这是一家专门评价中转站的网站,作者已经评价好了并打分,推荐了一些比较好。并且中转站的基本情况、价格。以及一些真实用户的。我还发现,他们的排名会经常变化。

https://t.co/KTAIfH3Lqg

2 hvoy

这个网站提供评测工具,用户可以自己评估是否是真实的模型,有没有参数。只输入需要评价的中转站url和你自己的api(注意,建一个临时的api,用完删掉)。

同时,它还有中转站的收录和价格,实际感觉价格不太准。

https://t.co/kPjuBgeszE

3 API Relay Audit

https://t.co/0Ui1Bhx6Wf

这是一个github的项目,专门用于全面审计第三方 AI API 中转站(反代/转发站)的安全性、可靠性和透明度。通过11 步审计,全方面的评估中转站的各方面的指标。可以用于深入专业的评估。

再推荐3个我常用的中转站吧

1 packyapi

它的体量应该在中转站属于头部吧,赞助了很多相关的开源项目。自己使用下来,感觉比较稳定。基本上在封号的时候,其他中转站挂了,它还能支撑。但是缺点的话,价格也属于比较贵的一批。claude code已经多次涨价。

所以,我会当做一个托底的中转站,别家用不了了,我就用它。

https://t.co/lkEPi1u6sN

2 米醋

这是我用的比较多的中转站。我用前面的的工具都评测过,都是真实的模型。大部分时候比较稳定,日常用它,偶尔不能用的时候转到packyapi。

最大的优势价格只有前面packyapi的一半,也是见过最便宜的中转站了。(有些更加便宜的,但是使用了一下是掺假的。)

https://t.co/6cRqn4P47i

3 ikun

这家用过一段时间,质量还行,稳定性也还行。但是后来claude code 涨价了,涨的好贵。但是codex依然便宜。

https://t.co/XJYJtMjh6l

其实中转站时候也不稳定,碰到大封号的时候,就会挂掉。之前还用过2个还不错的,因为封号都不干了。

还挺郁闷的,每过一段时间,政策变了,情况变了,就要重新搞一下ai工具。

将有用的内容保持到自己电脑,并形成知识库。这个逻辑走的第一步,我就遇到一个难题

微信、小红书、youtube等各平台不同平台内容,它都一一需要适配。

我突然灵机一动,想到了notebooklm,它是非常好的学习工具。但是换个角度,思路打开,它不就能处理各种类型内容吗?

于是我在github上面找到了notebooklm-py,已经1万多的star。它能解决内容处理的大部分格式了,并能够输出整理总结,连token的费用都省力了

1 天生就是 AI Agent 的技能

notebooklm-py 和普通 API 封装最大的区别——它从设计之初就是给 AI 编程代理用的。一条 `npx skills add` 命令装进 Claude Code 或 Codex,你的代理就能自主创建笔记本、导入资料、提问、生成内容——播客、视频、幻灯片、报告——

URL、PDF、YouTube、Google Drive、纯文本、音频、图片。浏览器里能喂的,这个库都能喂。

全程不用你打开浏览器。我上周把它配成 Claude Code 技能。现在我的代理自己跑完整条链路:导入我指定的 URL,生成音频概览,导出 JSON 格式的测验题,全部丢进文件夹。零手动步骤。整个循环自己转。

让强大产品变得可编程的开源工具,值得更多人知道。notebooklm-py 对 NotebookLM 做的就是这件事。

👉 https://t.co/E2Yl1pi0qC

发现一个好东西,它一句话就能把文章发到 8 个社交平台——而且网页改版了也不会挂。

我的文章一直只发推特,倒不是对x情有独钟,而是我很懒。同一篇内容,你要打开小红书粘贴一遍、打开知乎改一遍格式、打开微信公众号再排一遍版、打开 X 发一条摘要。五个浏览器标签页来回切,三十分钟就这么没了。我之前就是这么干的,每次发完内容都有种"我刚才干了什么"的虚无感。明明可以用来写下一篇文章的时间,全花在了复制粘贴上。

social-push 彻底解决了这个问题。它不是传统的脚本自动化,而是用 agent-browser——一个真正能"看懂"网页的 AI。

一句话发布 8 大平台

这是让我真正上头的功能。你在 AI 编程助手里输入一句 `/social-push 把这篇文章发到小红书`,AI 就会自动打开浏览器、进入编辑器、填标题、粘正文、加话题标签,最后存为草稿。目前支持 8 个平台:小红书图文、小红书长文、X/Twitter、知乎、微博、微信公众号、掘金、https://t.co/TAkVW56Ca2。我上周把一篇技术文章发了五个平台,前后不到四分钟。以前同样的操作要半个小时。

其他几个值得一提的点:

自进化——平台改版后,AI 自动检测页面变化、修复自己的 workflow 文件。你完全不用碰代码,它自己给自己打补丁。

Markdown 即配置——添加新平台只需要写一个 Markdown 文件描述操作步骤。没有脚本,没有选择器,没有代码。我参照现有模板,15 分钟就加了一个新平台。

安全设计——所有操作只到"暂存草稿",绝不会自动点"发布"按钮。发不发,你说了算。

如果你现在还在五个标签页之间来回粘贴同一篇文章,你正在浪费掉本该用来创作的时间。social-push 把这件苦差事变成了一句话的事。

https://t.co/fHpx26FoXG

发内容到中文社交平台的朋友,建议收藏。关注我,持续分享 AI 自动化好工具。

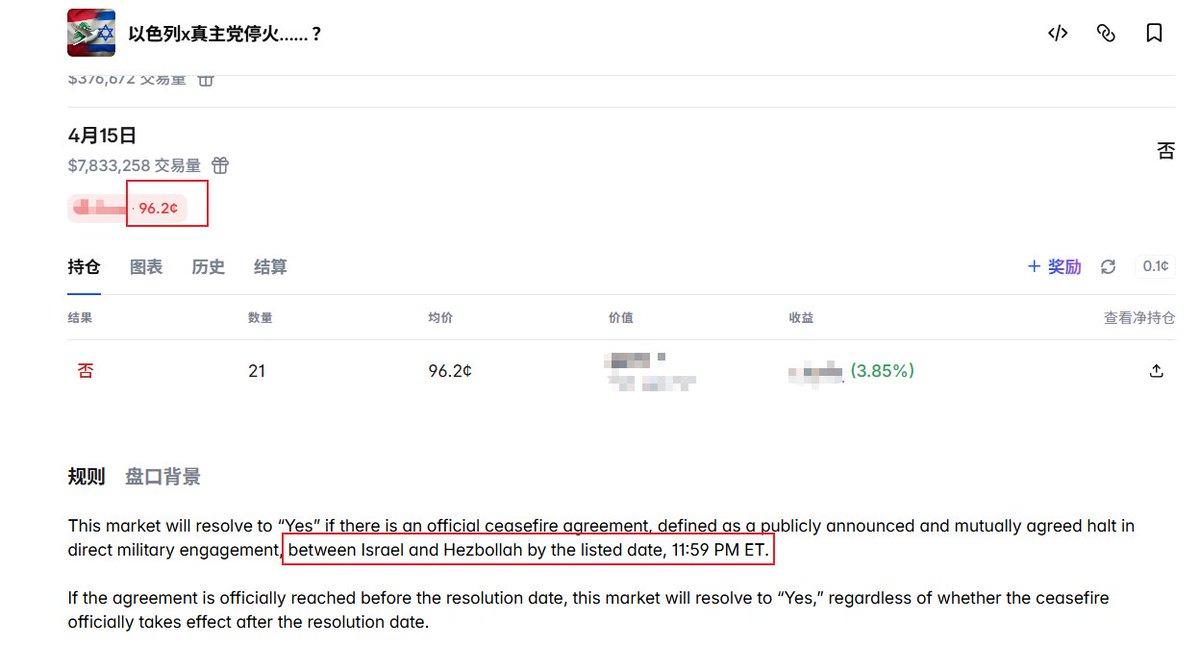

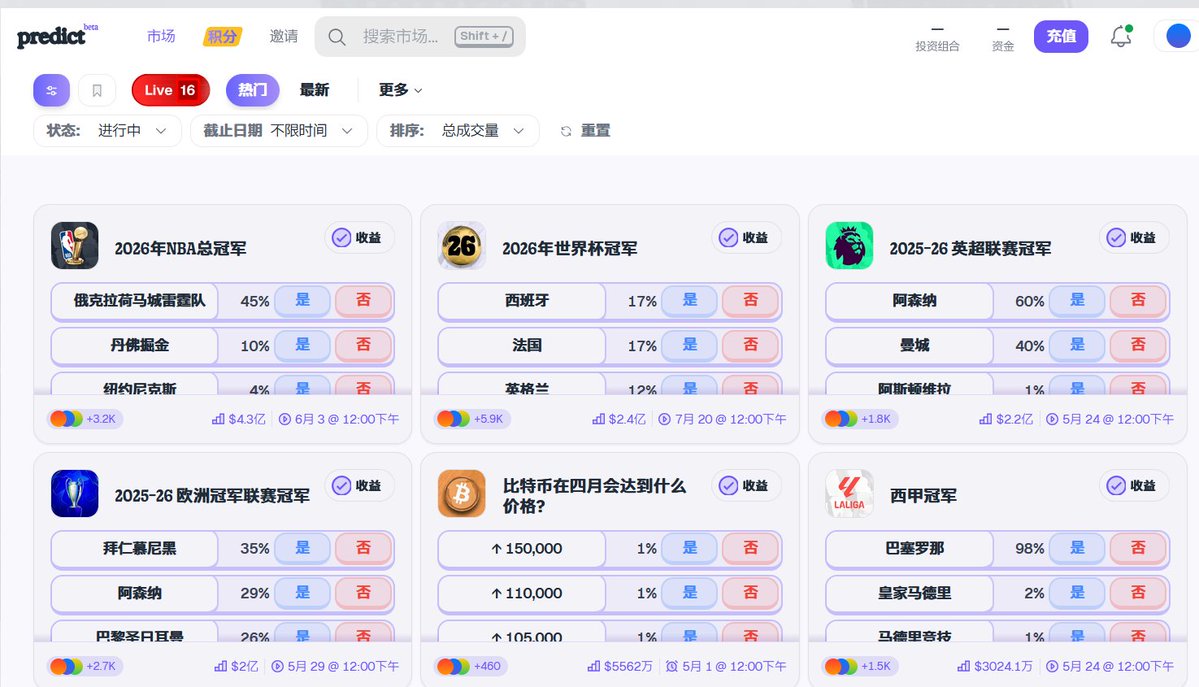

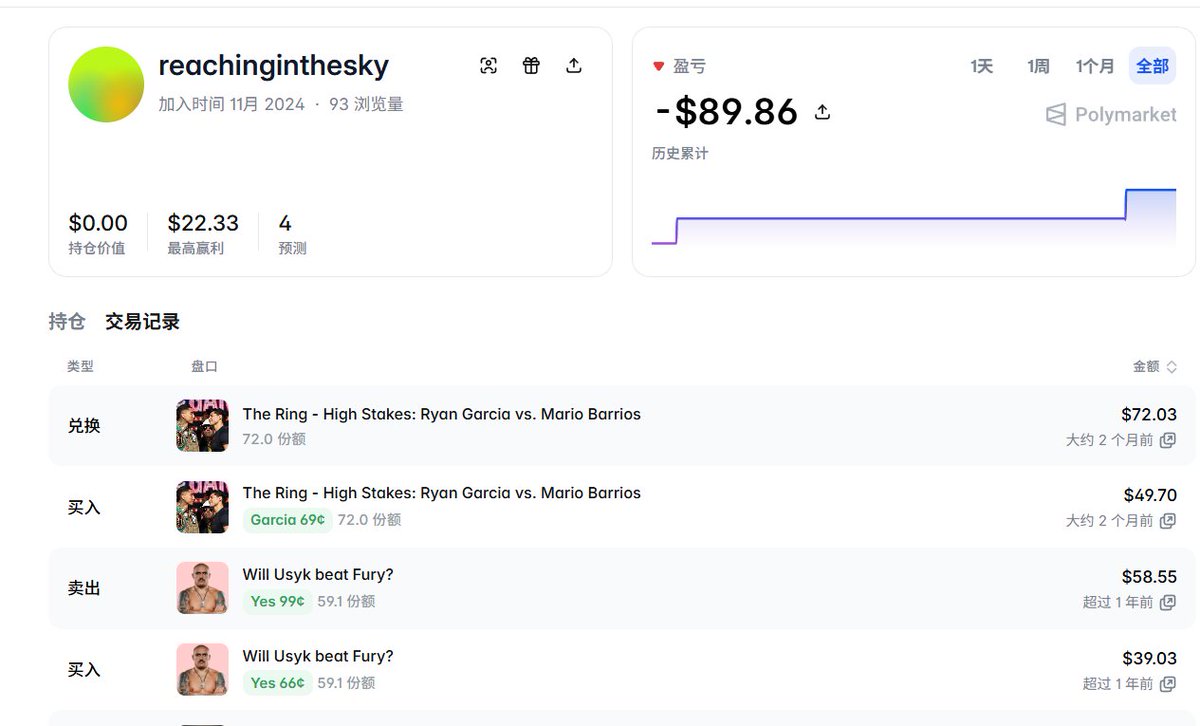

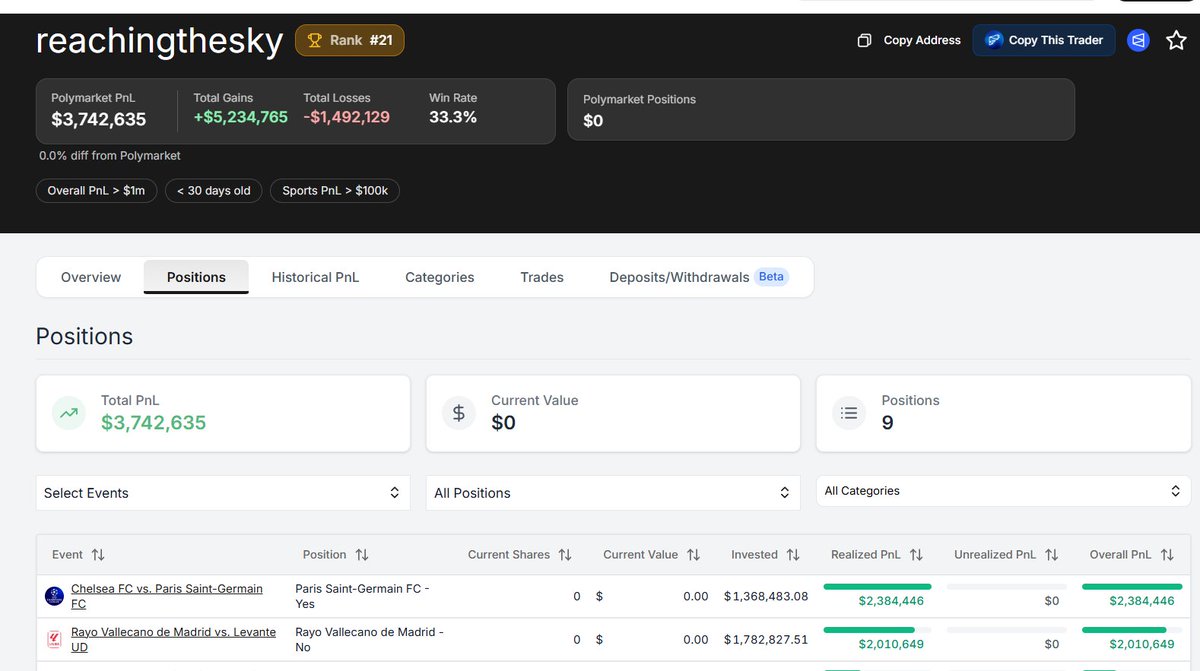

不要再使用polymarket的官方数据了!

做的实在是太差了!我已经不知道踩了多少坑!

正常逻辑,官网或者官方api获得数据是最可靠的

唯独我们的polymarket,非常之不靠谱

比如说这个地址reachingthesky,官网现实就是个菜逼。总共亏了90刀!实际上polygen链上的数据显示是超级大聪明!交易了8个市场,利润高达370万刀!!

如果你觉得拔链上不方便,可以考虑下面几个网站,我验证下数据比较准确的吧。

https://t.co/lHKyEKm2fN

这是一个专门针对去中心化预测平台 Polymarket 的数据分析平台。其核心功能是追踪链上地址的真实盈亏(PNL)、监控“聪明钱”动向,并解析复杂的链上交互操作。它的最大优点在于能够有效过滤套利机器人的干扰,提供比官方更精准的收益率维度,非常适合需要深度跟单和趋势研判的交易者。

Predictfolio https://t.co/s8Yywl4AGp

核心功能是帮助用户一站式汇总和管理在各个预测事件中的仓位、历史记录及预期收益。

Hashdive

https://t.co/SgJf4sNsKQ。它的核心功能侧重于追踪特定哈希值的交易流向、智能合约交互细节以及资金的底层异动。

想起了18年的时候,跟好友讨论RWA(当时还在空想阶段,名字还叫STO,通证经济等)。

当时我们的分歧在于是不是需要一个信用背书。他认为区块链是去中心化,所以不需要。而我认为,RWA比较特殊,将现实的资产上链是需要一个强有力的机构来做信用背书。

时间到了26年,RWA已经不再只是概念名词。这次刷推特,看到国泰君安在HashKey 上线了的代币化货币基金 GUSDT 和 GHKDT,无疑证明了我当时的观点。

一方面,作为券商老大的国泰君安能够发行代币化基金,本身就代表了RWA的认可。更重要的是,对于现实资产,用户是比较谨慎的。需要有个强有力的机构出面,让大家放心使用。更有利用RWA的大规模推广。 @HashKeyGroup

3个妙招,轻松节约80%的Token消耗

你有没有觉得,Token 消耗快得离谱?明明没聊几句,额度就快见底了。

这不是你的错。因为大模型公司就想让你多花token,所以现在方案都是最消耗token的。

但只要理解AI运行的原理,三个小改动就能把消耗砍掉一大半。

1:别让 AI 去"看"网页

这是最大的浪费源头。

很多人会每天获取50+网页总结热点。做法是让 AI 控制浏览器抓信息,觉得省事。但代价是什么?AI 浏览网页的时候,会把整个页面所有内容都读一遍——出了内容,甚至还有html代码,全算 Token。一个普通新闻页面可能上万 Token,你真正要的就几百个字。

特别是每天做信息收集、总结热点的人,这种浪费是翻倍放大的。

正确做法特别简单:能调 API 就调 API,普通网页写个爬虫脚本。脚本只抓你要的字段,干干净净,Token 基本为零。

2:给 Subagent 传文件路径,别替它"传话"

用 Agent 工作流的人最容易踩这个坑。

在现有方案中,都是主 Agent 会将所有信息阅读一遍,然后分配给Subagent。问题是——这些信息会全部过一遍主 Agent 的上下文,哪怕跟当前子任务完全没关系的,也一样算 Token。

解决办法很直觉:把数据写进文件,只告诉 Subagent 文件路径,让它自己去读需要的部分。主 Agent 上下文始终保持精简,Token 直接打骨折。

3:AI 是用来思考的,不是用来当 Excel 的

→ **大数据先用代码过滤**——别一股脑全丢给 AI。先用 Python 脚本做统计、筛选,把最关键的部分提炼出来,再让 AI 做判断和决策。

这三招为什么有效?

这是因为原理上,AI不是人,它没有记忆。每一次请求,你需要把把历史对话、工具定义、Skill、MCP 配置……全部打包发一遍。聊得越久,包越大,Token 蹭蹭涨。大模型公司当然不会主动教你怎么省——你用得多它才赚得多嘛。

如何操作?

改变也非常轻松,就是在 Skill 的时候多用 Script**——能用代码完成的步骤就封装成脚本,只把真正需要"动脑子"的环节留给 AI。操作上很简单,你在 Skill 里把这些步骤写成代码执行就行,其他流程完全一样。

这套方法还有个很多人没意识到的额外好处:**省 Token 的同时,AI 的准确率反而会提高**。

道理很简单——上下文越短,噪音越少,AI 越容易聚焦在关键信息上做出对的判断。上下文太长反而容易"分心",产生幻觉。

省钱和提质,其实是同一件事。

觉得有用的话转发给你身边也在用 AI 的朋友,感谢来个三连