最近沉迷 vibe coding,各大 AI 模型轮番上阵,但有一个越来越明显很让我苦恼的点:

上下文是一次性的。

我在 Claude 里写产品逻辑,在 GPT 里做架构推演,再切到开源模型做对比测试。结果不是模型不行,而是我的「思考过程」被强行打碎了。

不是在用 AI,而是在不停「重新介绍自己」。

这件事的本质,其实不是模型能力问题,而是 AI 生态的结构问题:

每个模型 = 一个封闭花园

记忆 = 平台资产,而不是用户资产

切换模型 ≈ 从零开始

这就是 AI 版的厂商锁定。

中心化产生的问题就该交给去中心化解决,最近关注到老牌 L1 ZetaChain 进化到 2.0 版本, 抓住这个结构性问题,并给出了一个产品化的解法。

从「连接链」,升级为「连接 AI」。不做模型,而是做一个 AI 互操作层:

AI Portal

一个入口,访问多个主流 / 开源模型

你选模型,而不是被模型选。

PML(私有记忆层)— 真正的核心

记忆是加密的,归用户所有

模型只是被授权「使用」,而不是「占有」

换模型,但上下文不丢

这一步,本质上是把 「记忆主权」 从 AI 平台手里拿回来。

@ZetaChain 最初是用「通用应用」解决 Web3 的碎片化,现在2.0 版本用同样的理论应用于解决 AI 碎片化。并且他们没有停在 infra 层,而是直接做了一个消费级入口:Anuma。

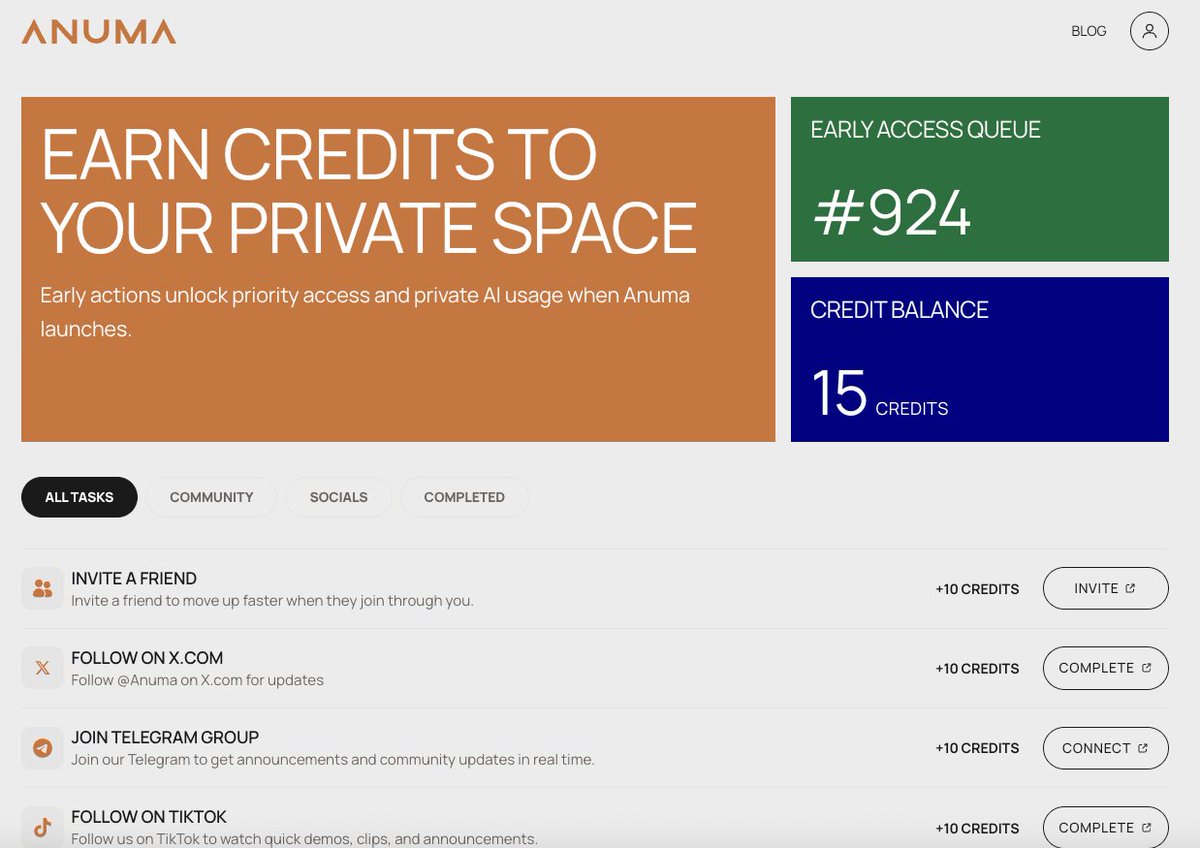

现在 Anuma 已经开放早期 waitlist,不用等邮件通知,直接就可以进入官网,做简单任务和邀请朋友,赚取 AI Credits(AI 积分)。积分会影响正式上线后的优先权和早期功能和福利。现在处于非常早期,感兴趣可以走我邀请

https://t.co/zXQU8KB25W

From X

Disclaimer: The above content reflects only the author's opinion and does not represent any stance of CoinNX, nor does it constitute any investment advice related to CoinNX.