🧠 LỜ-LỜ-MỜ (LLM)... LÀ CÁI QUÁI GÌ THẾ?

Trải nghiệm từ App nhưng vẫn nên có kiến thức từ nền tảng lên. Thôi hôm nay mình học 1 từ khoá nha 😁

Con AI này không biết gì hết… nhưng vẫn nói chuyện như chuyên gia

Nếu nói cho dễ hiểu, Large Language Model giống như một đứa “đọc gần hết internet”, nhưng công việc duy nhất của nó là dự đoán phần tiếp theo của câu. Trong AI gọi là next token prediction.

Ví dụ rất cơ bản trong bài gốc: “The cat sat on the ___”, nó điền “mat” vì trong dữ liệu nó đã học, câu này gần như luôn kết thúc như vậy.

Bạn thử đổi sang tiếng Việt: “Hôm nay trời rất ___”, nó sẽ điền “đẹp” hoặc “nóng” tùy ngữ cảnh trước đó. Toàn bộ cái gọi là “trí tuệ” bắt đầu từ việc đoán như vậy, chỉ là được lặp lại hàng tỷ lần.

Nó không đọc chữ như bạn… nó đọc số

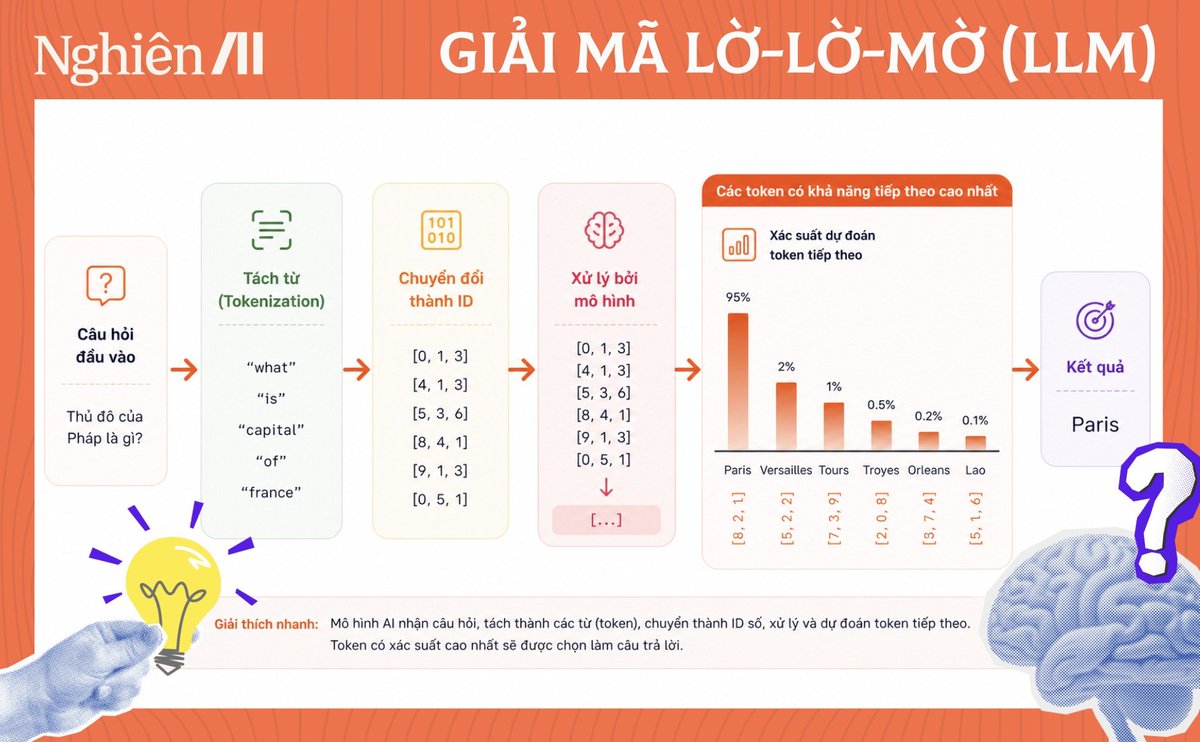

Một chi tiết nhiều người không để ý: model không hề thấy chữ. Bạn gõ “hello”, nó thấy một con số. Toàn bộ câu bạn nhập sẽ được tách thành token, rồi qua bước encoding thành số, chạy qua mạng neuron, rồi decoding lại thành chữ .

Ví dụ “cryptocurrency” có thể bị tách thành “crypto” và “currency”. Đây là lý do vì sao nó rất giỏi viết văn, nhưng lại fail mấy câu kiểu “từ strawberry có mấy chữ r”.

Với bạn là chuyện đếm chữ, với nó là xử lý một vài con số không liên quan đến từng ký tự.

Đọc nhiều quá nên viết cái gì cũng giống thật

Khi bạn hỏi “giải thích blockchain”, nó sẽ viết kiểu: blockchain là gì, sau đó nói về block, hash, consensus, rồi kết lại bằng ứng dụng.

Nghe rất giống một bài viết của dân trong ngành. Nhưng thực tế nó chỉ đang ráp lại từ những pattern đã thấy trong hàng triệu bài viết. Nó biết cấu trúc phổ biến của một bài giải thích, nên nó tái tạo lại.

Một ví dụ khác dễ thấy hơn: bạn bảo nó “viết caption bán hàng mỹ phẩm”, nó sẽ tự động viết kiểu cảm xúc, thêm emoji, thêm lời kêu gọi mua.

Nhồi càng nhiều info càng tốt? Sai lầm kinh điển

Một khái niệm quan trọng là context window, tức là lượng thông tin tối đa model có thể “giữ trong đầu” tại một thời điểm. Ví dụ model có 200k tokens context window thì chỉ xử lý được từng đó.

Giả sử bạn đưa cho nó 500,000 token tài liệu, trong đó có một thông tin quan trọng nằm ở giữa, rồi bạn hỏi một câu liên quan đến chi tiết đó. Nghe thì có vẻ chắc chắn nó sẽ trả lời đúng vì đã có đủ data. Nhưng thực tế nó dễ bỏ sót vì bị phân tán sự chú ý.

Ngược lại, nếu bạn chỉ đưa 10,000 token đúng trọng tâm, nó trả lời chính xác hơn nhiều .

Nó không nói dối… nó chỉ “bịa rất hợp lý”

Hiện tượng này gọi là hallucination. Model không tra cứu dữ liệu, không kiểm chứng sự thật, nó chỉ tạo ra câu trả lời nghe hợp lý nhất.

Ví dụ bạn hỏi “Bitcoin là gì”, nó trả lời rất ổn vì thông tin này xuất hiện khắp nơi. Nhưng bạn hỏi “công ty ABC ở Việt Nam gọi vốn bao nhiêu năm 2019”, nếu dữ liệu này hiếm, nó vẫn trả lời và có thể bịa ra một con số kiểu “5 triệu USD” nghe rất hợp lý.

Càng nhiều “não” thì càng khôn… nhưng cũng càng tốn tiền

Bạn hay nghe về parameters, ví dụ 7B, 70B, hay 1T. Đây là số lượng “trọng số” trong model. Bạn có thể hiểu đơn giản là càng nhiều parameters thì model càng học được pattern phức tạp hơn.

Một ví dụ cụ thể: bạn đưa cùng một prompt “viết bài phân tích thị trường crypto”, model nhỏ sẽ viết rất chung chung. Model lớn sẽ biết chia đoạn, đưa luận điểm, phản biện, và giữ mạch logic tốt hơn. Đổi lại, model lớn tốn nhiều compute hơn, chi phí cao hơn và chạy chậm hơn.

Tóm lại là nó là đứa đọc hết internet… nhưng không chịu trách nhiệm về sự thật

Bạn chỉ cần giữ một mental model rất rõ: LLM là hệ thống next token prediction chạy trên token, hoạt động trong một context window giới hạn và được học qua hàng tỷ parameters. Nó cực giỏi tạo ra văn bản nghe hợp lý, nhưng không tự đảm bảo đúng.

Nếu bạn dùng nó để viết content, brainstorm, hoặc code cơ bản, nó rất mạnh. Nhưng nếu bạn dùng nó để lấy số liệu, fact cụ thể mà không kiểm chứng lại, bạn sẽ gặp rủi ro.

🟠Join FB Group của @nghienaivn để xoá mù AI trong 2 tháng!

https://t.co/wOX7GsW3qv

---

From X

Disclaimer: The above content reflects only the author's opinion and does not represent any stance of CoinNX, nor does it constitute any investment advice related to CoinNX.