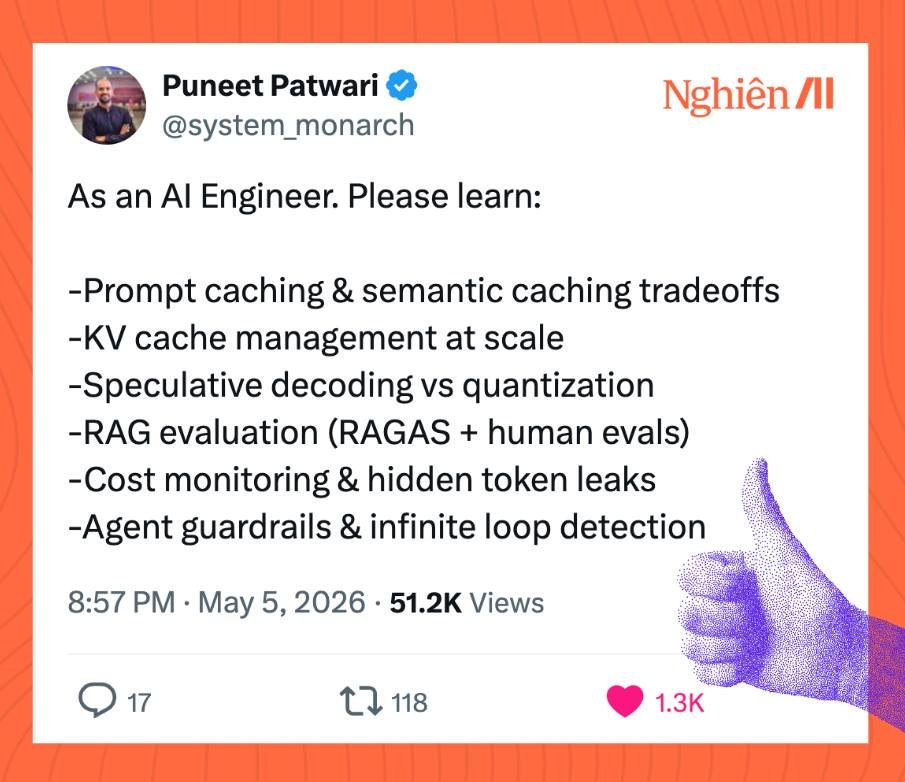

✍️ Nếu muốn trở thành kỹ sư AI, hãy học những thứ sau

Theo lời khuyên của Kỹ sư Phần mềm tại Atlassian

🟠 Prompt caching & semantic caching

Khi build AI production thật sự, vấn đề lớn nhất thường không còn là “model có thông minh không”, mà là hệ thống có chạy đủ nhanh và đủ rẻ không.

Đó là lý do caching (lưu sẵn kết quả cũ) gần như bắt buộc. Prompt caching hoạt động kiểu: prompt giống hệt → trả lại kết quả cũ thay vì gọi model suy nghĩ lại từ đầu.

Semantic caching nâng cấp hơn một chút. Hệ thống sẽ cố hiểu xem hai câu có cùng ý nghĩa hay không. Ví dụ: “RAG là gì?” và “RAG hoạt động như thế nào?" có thể dùng chung cache dù câu chữ khác nhau.

Điểm đánh đổi nằm ở chỗ cache càng mạnh thì càng nhanh và rẻ, nhưng cũng càng dễ lấy nhầm ngữ cảnh hoặc dùng lại output cũ không còn phù hợp.

🟠 KV cache management

KV cache (bộ nhớ tạm của model) là một trong những lý do ChatGPT trả lời nhanh như hiện tại.

Khi AI đang generate từng token, nó không muốn đọc lại toàn bộ context từ đầu mỗi lần viết thêm một chữ mới. KV cache giúp model lưu sẵn “trạng thái suy nghĩ” trước đó để tái sử dụng.

Hiểu đơn giản giống như bạn đang đọc sách và dùng bookmark thay vì mỗi lần đọc tiếp lại mở từ trang 1.

Nhưng KV cache rất tốn VRAM. Context càng dài thì cache càng lớn. Khi có hàng triệu user dùng cùng lúc, việc quản lý memory (bộ nhớ), batching (gom request) và GPU efficiency (hiệu suất GPU) trở thành bài toán cực khó.

🟠 Speculative decoding vs quantization

Đây là hai kỹ thuật tối ưu inference (quá trình AI tạo output) phổ biến nhất hiện nay.

Speculative decoding hoạt động kiểu model nhỏ “viết nháp” trước, sau đó model lớn chỉ cần kiểm tra lại thay vì tự suy nghĩ toàn bộ từ đầu. Giống như intern làm draft rồi senior review lại.

Quantization là kỹ thuật nén model để giảm VRAM và chạy nhanh hơn trên GPU yếu hoặc máy local.

Tradeoff là model càng nhẹ thì càng rẻ và dễ deploy, nhưng đôi khi reasoning (khả năng suy luận) và chất lượng output cũng giảm theo.

Còn tiếp 👇

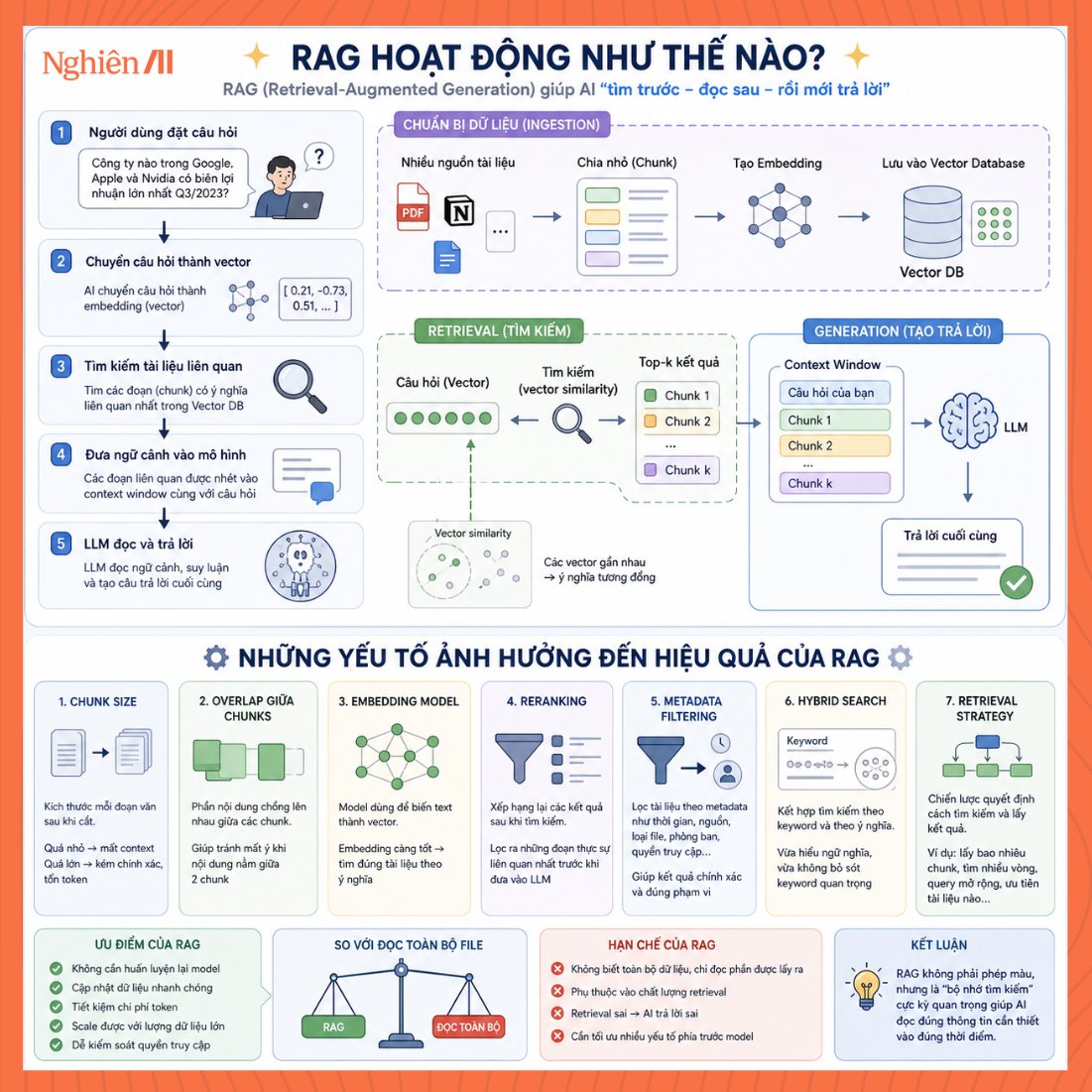

💯 [Giải ngố] RAG có thực sự thần kỳ không mà ai cũng tung hô?

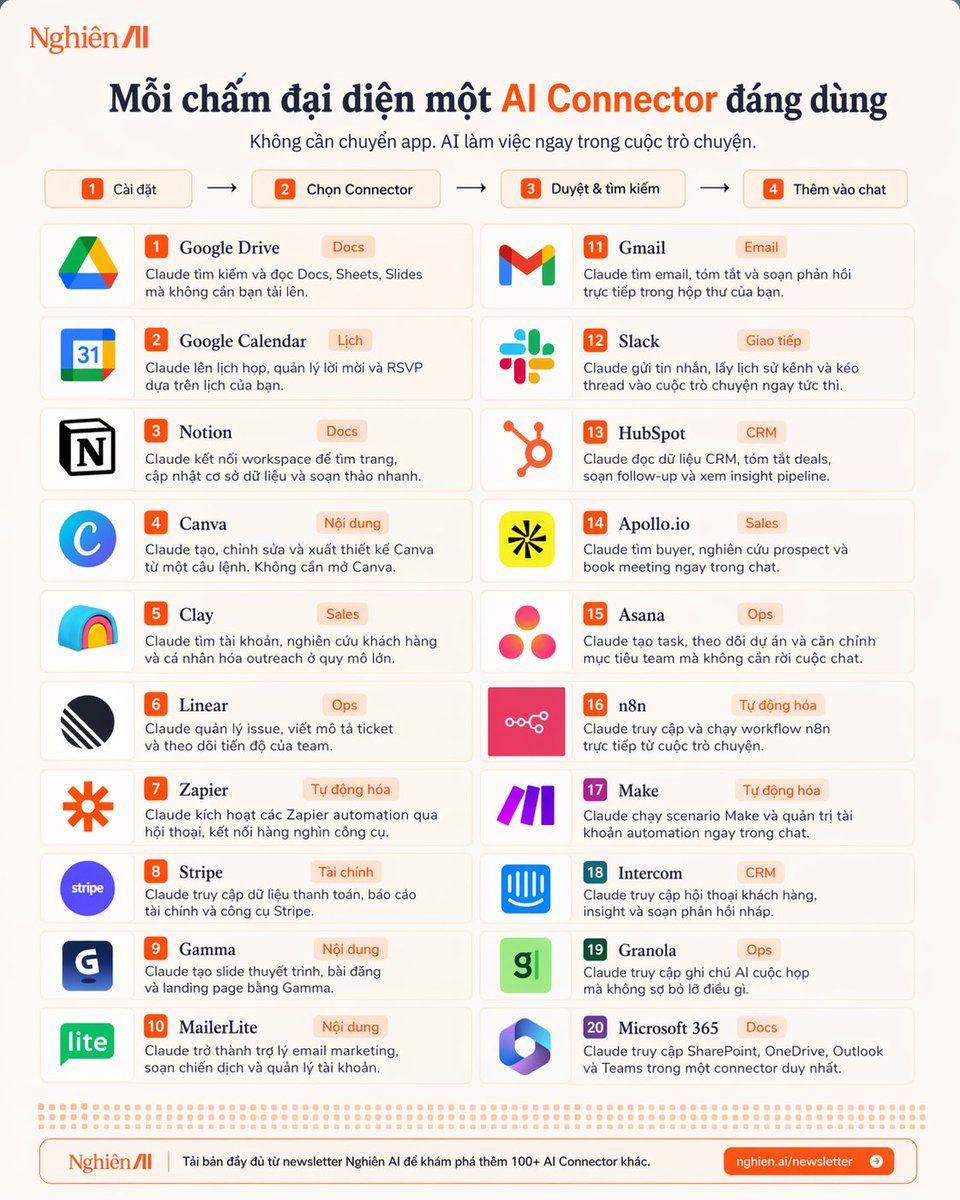

RAG (Retrieval-Augmented Generation) đang là công nghệ xuất hiện khắp nơi trong AI doanh nghiệp, từ chatbot đọc PDF cho tới AI kết nối Notion, CRM hay dữ liệu nội bộ.

Nhưng thực ra RAG không làm AI “thông minh hơn thần kỳ”. Nó đơn giản là cơ chế giúp AI “search trước rồi mới đọc”.

Bình thường, các model như ChatGPT chỉ trả lời dựa trên dữ liệu đã được train sẵn. Nó không tự biết file PDF mới upload hay tài liệu nội bộ công ty. RAG giải quyết chuyện đó bằng cách cắt tài liệu thành nhiều đoạn nhỏ, biến chúng thành embedding vectors rồi lưu vào vector database. Khi user hỏi, hệ thống sẽ search những đoạn liên quan nhất rồi đưa vào context window để AI đọc trước khi trả lời.

Điểm quan trọng là AI không đọc toàn bộ dữ liệu. Nó chỉ đọc vài đoạn được retrieval system lấy ra tại thời điểm query.

Đây là lý do RAG cực kỳ quan trọng trong thực tế. Vì context window hiện tại vẫn hữu hạn và token rất đắt.

Một công ty có thể có hàng triệu ticket support, hàng chục nghìn file PDF hay hàng GB dữ liệu nội bộ nên gần như không thể nhét toàn bộ vào context mỗi lần AI trả lời.

RAG hoạt động như một lớp “bộ nhớ tìm kiếm”, giúp AI chỉ đọc đúng phần cần thiết. Nhưng đây cũng là điểm yếu lớn nhất của nó. Nếu retrieval search sai tài liệu, thiếu context hoặc lấy chưa đủ thông tin thì AI vẫn trả lời sai dù model phía dưới rất mạnh.

Đó là lý do phần khó nhất của RAG thường nằm ở retrieval engine phía trước model, chứ không phải bản thân LLM.

Để RAG hoạt động hiệu quả, phía dưới phải tối ưu rất nhiều thứ:

- Chunk Size: Kích thước mỗi đoạn text sau khi cắt. Chunk quá nhỏ thì mất context, chunk quá lớn thì retrieval kém chính xác và tốn token hơn.

- Overlap Between Chunks: Phần nội dung chồng lên nhau giữa các chunk để tránh mất ý khi một đoạn văn nằm giữa ranh giới hai chunk.

- Embedding Model: Model dùng để biến text thành vector ý nghĩa. Embedding càng tốt thì khả năng tìm đúng tài liệu càng cao.

- Reranking: Sau khi retrieval lấy ra nhiều đoạn liên quan, reranker sẽ chấm điểm lại để chọn vài đoạn thực sự phù hợp nhất trước khi đưa vào LLM.

- Metadata Filtering: Lọc tài liệu theo thời gian, phòng ban, loại file, user hoặc quyền truy cập để retrieval chính xác hơn.

- Hybrid Search: Kết hợp semantic search và keyword search để vừa hiểu nghĩa vừa không bỏ sót exact keyword quan trọng.

- Retrieval Strategy: Logic quyết định cách search, lấy bao nhiêu chunk, search bao nhiêu vòng hay có dùng agent query expansion hay không.

Thực tế hiện nay, nhiều AI doanh nghiệp mạnh hơn không hẳn vì model tốt hơn. Họ mạnh hơn vì retrieval system, context engineering và orchestration phía sau tốt hơn.

RAG không phải phép màu. Nó là bài toán “đưa đúng context vào đúng thời điểm” và đó đang là một trong những khó khăn lớn nhất của AI hiện đại.

Follow @nghienaivn để update kiến thức liên tục về AI

🟠 https://t.co/wOX7GsW3qv

---

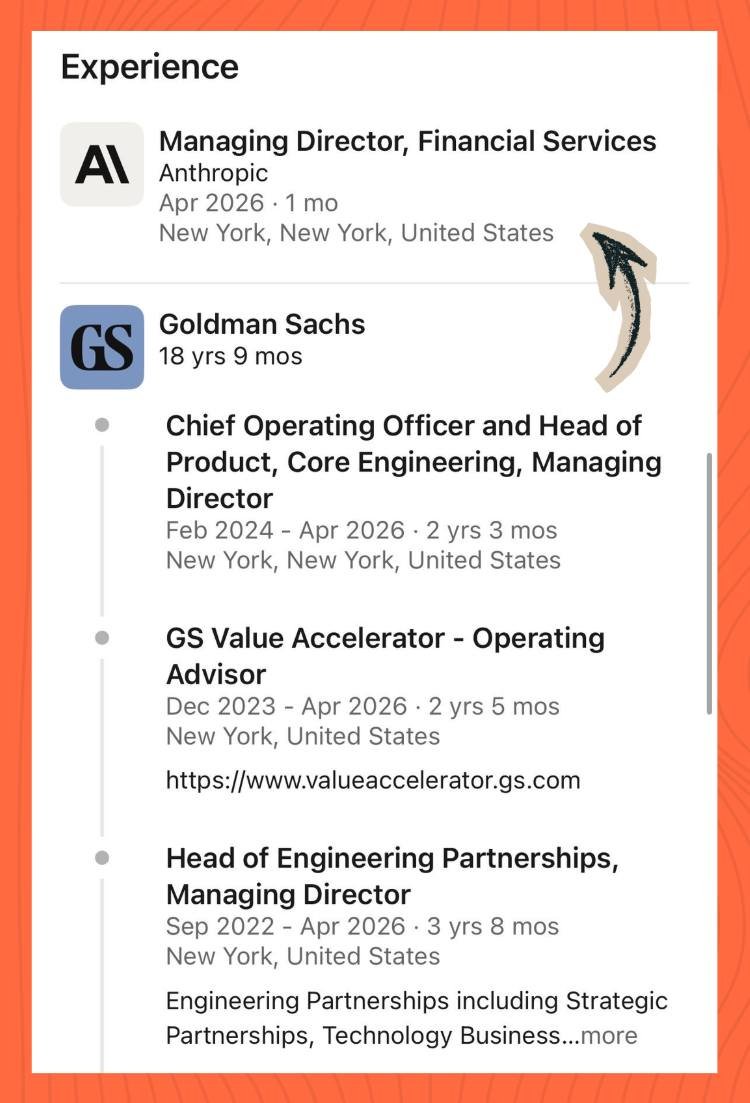

Anthropic càn quét ngành dịch vụ tài chính bằng Claude và đây là người họ tuyển 👇

Giám đốc Vận hành (COO) kiêm Trưởng bộ phận Sản phẩm và Kỹ thuật lõi làm gần 19 năm tại một trong những tổ chức tài chính lớn nhất thế giới aka Goldman Sachs để trở thành...

Giám đốc Điều hành phụ trách Dịch vụ Tài chính tại Anthropic!

Thông tin thú vị là 40% trong số 50 khách hàng hàng đầu của Anthropic là các tổ chức tài chính. Sắp tới Mythos ra mắt thì ngành cyber security sẽ tiếp tục bị càn quét.

Mà thời này AI còn chưa kết hợp mạnh với robot...

✅ 21 yếu tố quan trọng nhất ảnh hưởng đến câu trả lời của AI

1/ Temperature

Độ “sáng tạo” của AI. Temperature thấp thì AI trả lời ổn định, an toàn và ít random hơn. Hợp cho coding, phân tích dữ liệu hay workflow cần tính chính xác. Temperature cao thì AI sáng tạo hơn, brainstorm đa dạng hơn nhưng dễ hallucination hơn.

Ví dụ:

Temperature = 0 → hỏi nhiều lần gần như ra cùng đáp án

Temperature = 1.2 → mỗi lần có thể trả lời khác hẳn

2/ Top-p

Giới hạn phạm vi token AI được phép chọn tiếp theo. Hiểu đơn giản là AI chỉ được chọn trong nhóm từ có xác suất cao nhất thay vì toàn bộ từ vựng. Top-p thấp giúp output tập trung hơn, top-p cao giúp output đa dạng hơn.

3/Max Tokens

Giới hạn độ dài output. Nếu để quá ngắn, AI sẽ bị cắt giữa chừng. Nếu để quá dài sẽ tăng chi phí và đôi khi khiến AI lan man hơn.

4/ Context Window

Lượng thông tin AI có thể nhìn cùng lúc. Ví dụ: 8k token, 32k token, 128k token, 1M token.

Context window càng lớn thì AI càng đọc được nhiều file, nhiều đoạn chat và nhiều tài liệu hơn trong một lần xử lý. Nhưng cũng không phải càng nhiều là càng tốt, mà đôi khi càng cô đọng thì sẽ ra được kết quả chính xác hơn.

5/ System Prompt

“Luật nền” điều khiển hành vi AI. Đây là thứ quyết định AI đóng vai trò gì, giọng văn ra sao, được phép hay không được phép làm gì. System prompt thường ảnh hưởng cực mạnh tới output.

Ví dụ: “Bạn là chuyên gia tài chính", “Trả lời ngắn gọn”, “Luôn viết bằng tiếng Việt”...

6/ Conversation History

Toàn bộ lịch sử chat trước đó. AI dùng phần này để giữ mạch hội thoại và hiểu ngữ cảnh hiện tại. Đó là lý do chat càng dài thì AI càng “hiểu mình hơn”.

7/ Memory

Bộ nhớ dài hạn lưu sở thích, thói quen hoặc thông tin người dùng. Memory giúp AI cá nhân hóa câu trả lời giữa nhiều cuộc trò chuyện khác nhau.

8/ RAG (Retrieval-Augmented Generation)

Cơ chế nhét thêm tài liệu ngoài vào context trước khi AI trả lời. RAG giúp AI trả lời dựa trên dữ liệu riêng thay vì chỉ dùng kiến thức pretrain.

Ví dụ: PDF nội bộ, Notion, Google Drive, Vector Database

9/ Embedding Quality

Chất lượng embedding quyết định khả năng tìm đúng context trong RAG system. Embedding càng tốt thì AI càng lấy đúng tài liệu liên quan.

10/ Fine-tuning

Huấn luyện thêm model cho domain hoặc phong cách cụ thể. Fine-tune giống như “đào tạo nghề” thêm cho model. Ví dụ: AI chuyên luật, AI chuyên y tế, AI viết theo style riêng

11/ RLHF (Reinforcement Learning from Human Feedback)

Lớp huấn luyện hành vi bằng feedback con người. Đây là thứ giúp AI trả lời tự nhiên, an toàn và “giống trợ lý” hơn.

12/ Sampling Strategy

Cách model chọn token tiếp theo. Temperature và Top-p thực ra nằm trong nhóm sampling này. Sampling khác nhau → output khác nhau dù cùng model.

13/ Seed

Con số cố định randomness. Dùng để tái tạo kết quả giống nhau giữa nhiều lần chạy. Rất quan trọng khi testing hoặc benchmark model.

14/ Quantization

Nén model để chạy nhẹ hơn trên GPU yếu hoặc máy local. Quantization giúp tiết kiệm VRAM nhưng đôi khi làm giảm chất lượng output.

15/ Inference Engine

Hệ thống dùng để serve model. Cùng một model nhưng inference stack khác nhau vẫn có thể cho tốc độ và chất lượng khác nhau. Ví dụ: vLLM, Ollama, TensorRT-LLM, Groq stack,...

16/ GPU / Hardware

Phần cứng ảnh hưởng trực tiếp tới: tốc độ, context length, batch size, khả năng chạy model lớn. Đó là lý do NVIDIA gần như trở thành “xương sống” của ngành AI hiện tại vì GPU hoạt động hiệu quả.

17/ Agent Loop

Cách AI tự suy nghĩ nhiều bước và gọi tool liên tục. Agent loop càng tốt thì AI càng “giống nhân viên” thay vì chatbot.

Ví dụ: AI tự search web, tự đọc file, tự sửa code, tự kiểm tra output

18/ Tool Calling

Khả năng dùng công cụ ngoài như browser, Python, database, email, calendar, API. Tool giúp AI vượt khỏi giới hạn “chỉ chat text”.

19/ Context Engineering

Cách sắp xếp, nén và quản lý context trước khi đưa vào model. Đây đang là một trong những lợi thế cạnh tranh lớn nhất của các AI product hiện nay.

20/ Training Data

Dữ liệu dùng để train model. Dữ liệu càng lớn và chất lượng càng cao thì model càng thông minh. Đây là “nguồn thức ăn” của AI.

21/ Model Architecture

Kiến trúc nền phía dưới model. Hiện tại phần lớn AI text hiện đại đều dùng Transformer hoặc biến thể từ Transformer.

Đó là lý do cùng một nền móng nhưng mỗi công ty vẫn tạo ra chất lượng rất khác nhau bằng cách tối ưu toàn bộ stack phía trên.

AI hiện đại thực ra không còn là “một model”. Nó là cả một hệ thống gồm model + dữ liệu + context + memory + sampling + tools + agent + inference stack + orchestration.

🟠 Follow @nghienaivn để cập nhật kiến thức hữu ích về AI

https://t.co/wOX7GsW3qv

-----

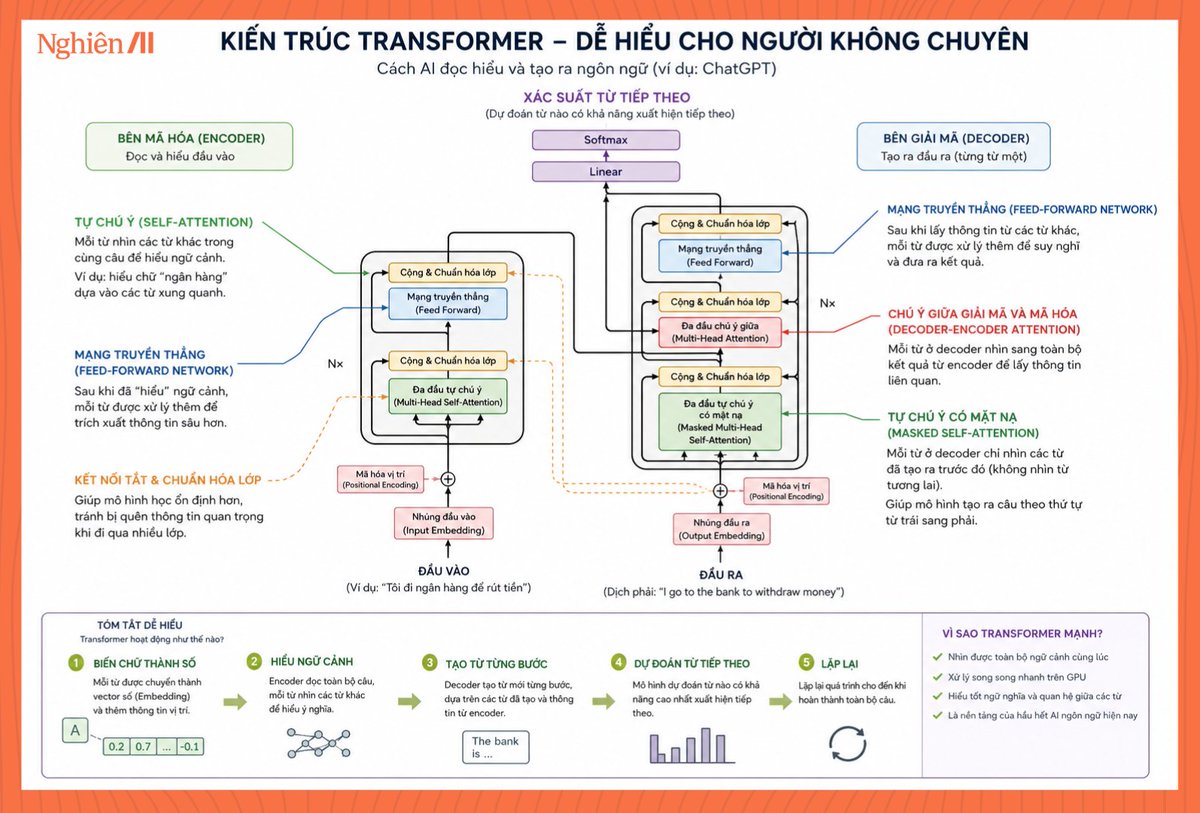

🧠 [Mỗi ngày 1 từ khoá] Kiến trúc Transformer của Google là gì mà gần như toàn bộ AI hiện nay đều chạy trên nó?

Thứ Google tạo ra năm 2017 không chỉ là một AI model mới, mà là một cách hoàn toàn mới để máy hiểu ngôn ngữ.

Trước Transformer, AI đọc văn bản theo kiểu tuần tự từng token một nên rất khó nhớ context dài. Đọc càng xa thì càng mất liên kết với phần đầu câu.

Transformer giải quyết chuyện đó bằng cơ chế “Attention”. Thay vì chỉ nhìn vài chữ gần nhất, model có thể nhìn toàn bộ câu cùng lúc để hiểu ngữ cảnh.

Ví dụ câu:

- “Tôi đi ngân hàng để rút tiền” → hiểu “ngân hàng” là bank tài chính.

- “Tôi ngồi bên bờ ngân hàng” → hiểu theo nghĩa địa lý.

Đây là bước nhảy cực lớn vì AI bắt đầu hiểu context thay vì chỉ đoán token tiếp theo. Transformer cũng cực kỳ hợp với GPU vì có thể xử lý song song cả đoạn văn cùng lúc. Trong khi các kiến trúc cũ như RNN hay LSTM phải đọc từng token tuần tự nên train rất chậm.

Đó là lý do sau 2017, toàn ngành AI tăng tốc khủng khiếp:

- Model scale lớn hơn

- Dataset scale lớn hơn

- GPU cluster scale lớn hơn

- Khả năng AI tăng theo cấp số nhân.

Ngay trong tên ChatGPT cũng đã có chữ Transformer: Generative Pretrained Transformer.

Hiện tại gần như mọi công ty AI lớn như OpenAI, Anthropic, Meta hay DeepSeek đều xây trên nền móng này. Họ cạnh tranh ở dữ liệu, cách train, inference hay agent system, nhưng phần lõi xử lý ngôn ngữ vẫn là Transformer.

Đây cũng là lý do các công ty AI Trung Quốc chưng cất model rất nhanh. Vì phần lớn AI text hiện đại đều dùng cùng kiểu kiến trúc, nên việc transfer knowledge giữa các model dễ hơn rất nhiều. Giống như cả ngành đang dùng chung một loại động cơ, còn mỗi công ty tối ưu chiếc xe riêng của mình.

Follow @nghienaivn để bắt kịp AI trong 2 tháng!

https://t.co/wOX7GsW3qv

----

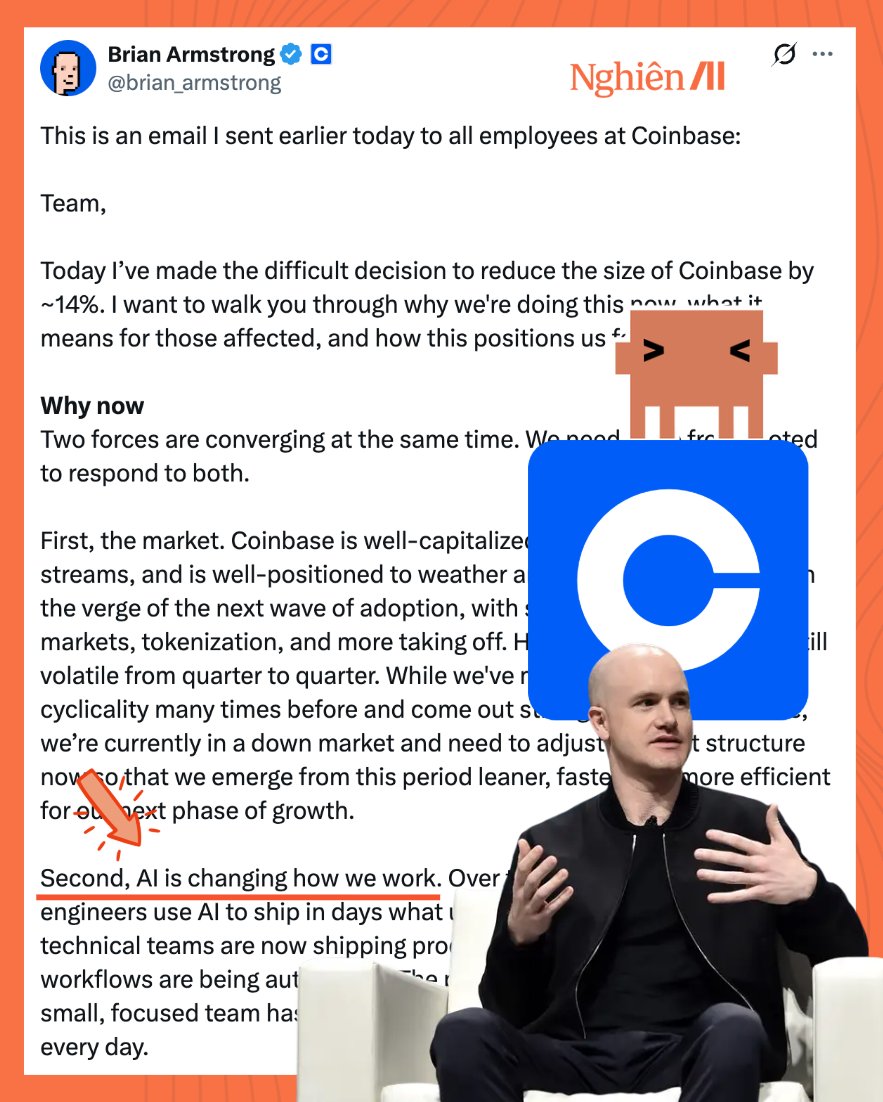

⚠️ CEO Coinbase thông báo giảm 14% nhân sự vì AI & Cách cấu trúc lại công ty khi có AI

Brian Armstrong vừa gửi internal memo cho toàn bộ nhân viên Coinbase để giải thích vì sao công ty cắt giảm khoảng 14% nhân sự. Nhưng thứ đáng chú ý nhất trong email này nằm ở phần ông mô tả cách Coinbase đang thiết kế lại cả hệ thống vận hành xoay quanh AI.

Theo Brian, năng suất làm việc trong nội bộ đã thay đổi cực mạnh chỉ trong 1 năm. Các engineer dùng AI để ship sản phẩm trong vài ngày thay vì vài tuần. Team non-tech giờ cũng có thể tạo production code và tự động hóa workflow của riêng mình.

Điều này khiến Coinbase bắt đầu chuyển sang một mô hình tổ chức hoàn toàn khác.

Công ty sẽ làm phẳng cấu trúc quản lý, giới hạn tối đa 5 tầng dưới CEO/COO để tăng tốc độ ra quyết định. Các leader sẽ quản lý nhiều người hơn và đồng thời trực tiếp tham gia execution giống một “player-coach”.

Coinbase cũng bắt đầu xây các “AI-native pod” - những team cực nhỏ nhưng leverage rất mạnh nhờ AI agents. Một người có thể quản lý nhiều agent cùng lúc để xử lý coding, research, support, operation hay product workflow.

Thậm chí Coinbase còn thử nghiệm mô hình “one person team”, nơi một cá nhân kiêm luôn vai trò PM, design và engineering với AI là lớp hạ tầng hỗ trợ phía dưới.

Câu thú vị nhất trong memo là: “Rebuilding Coinbase as an intelligence, with humans around the edge aligning it.”

Hiểu đơn giản là Coinbase đang muốn biến công ty thành một hệ thống trí tuệ vận hành bằng AI, còn con người tập trung vào định hướng, kiểm soát context và ra quyết định cuối cùng.

Đây cũng là thứ đang bắt đầu xuất hiện ở rất nhiều công ty AI-native hiện nay: team nhỏ hơn, tốc độ execution nhanh hơn, ít layer hơn và output trên mỗi nhân sự tăng mạnh nhờ agent.

Trước đây muốn scale công ty thì phải tuyển thêm người. Bây giờ muốn scale công ty thì phải tăng leverage bằng AI.

#nghienAI

Doanh nghiệp một người (OPC) - Điều không thể nào làm được nếu như không giỏi AI 💯

Vừa đây, trang Thông tin Chính phủ đã đăng bài về việc ban hành Chiến lược quốc gia về khởi nghiệp sáng tạo đã lần đầu tiên đặt vấn đề thí điểm mô hình "doanh nghiệp một người" (One-Person Company – OPC), nhằm đưa khởi nghiệp trở thành cơ hội thực tế với mọi người dân, thay vì chỉ dành cho một nhóm nhỏ doanh nghiệp có điều kiện.

Từ góc độ cá nhân, mình cũng đang học để xây dựng được OPC nhưng phải nói là khó cực kỳ. Chưa cần đạt đến trình độ One Company, chỉ cần build được AI Agent để đảm nhận công việc của một người, một team đã không dễ.

Nhưng đây sẽ là xu hướng chung của toàn thế giới mà không ai có thể ngăn cản. Một là phải all-in học, còn không thì sẽ bị bỏ lại.

Join cộng đồng @nghienaivn tại đây 👇

https://t.co/wOX7GsW3qv

-----

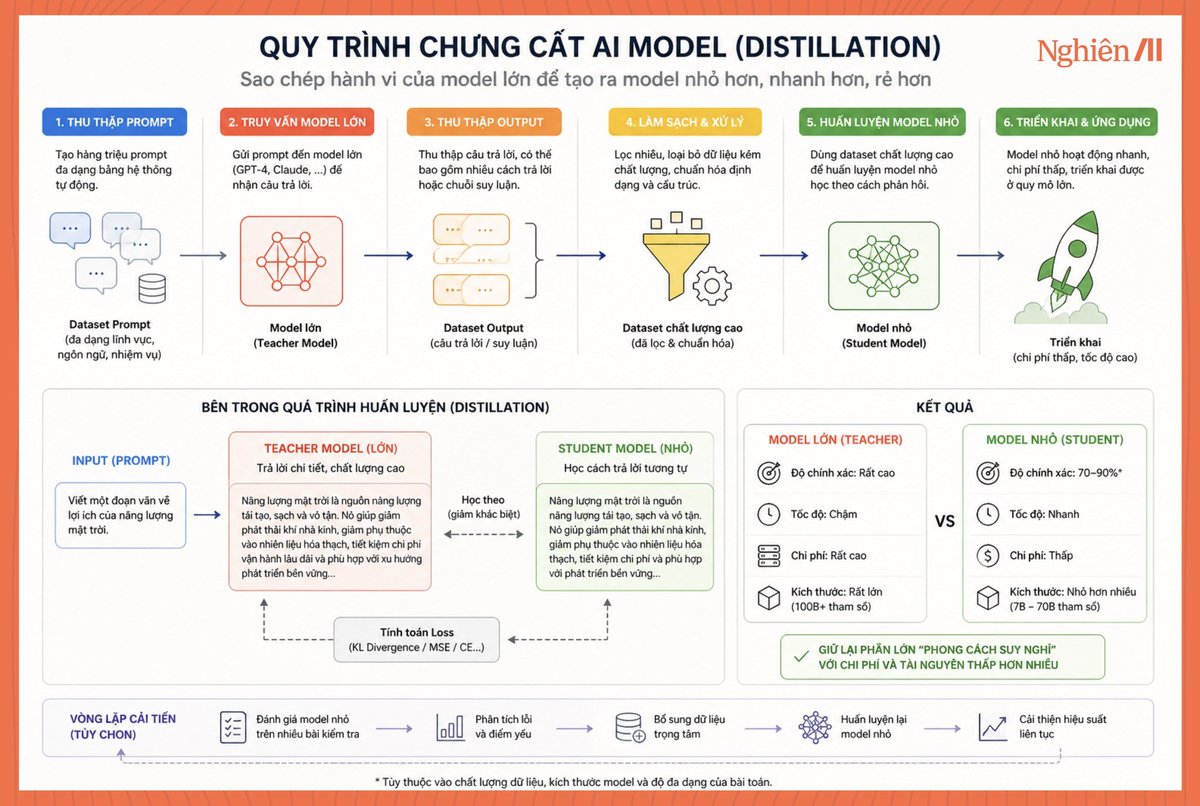

[Tới giờ học] Mấy anh Trung Quốc đã clone AI model đạt 80% bản gốc rồi bán giá 1/10 như thế nào? 😁

Điểm mấu chốt nằm ở chưng cất: lấy cách trả lời của model lớn làm dữ liệu, rồi dạy lại cho model nhỏ. LLM vốn chỉ là hệ dự đoán token tiếp theo, nên nếu có đủ nhiều cặp hỏi – đáp chất lượng cao, model nhỏ sẽ học được pattern đó.

Trong lúc huấn luyện, họ tối ưu hai thứ cùng lúc:

- Học đúng câu trả lời (cross-entropy)

- Học “độ tự tin” của từng từ mà model lớn đã chọn (KL-divergence trên logits).

Nhờ vậy, model nhỏ không chỉ trả lời đúng ý mà còn giữ được độ mượt và ổn định.

Phần quyết định chất lượng nằm ở pipeline dữ liệu. Các team như Moonshot, https://t.co/uBFZm5Tpwu, DeepSeek không bắn prompt ngẫu nhiên mà thiết kế bộ câu hỏi phủ đúng các tình huống dùng thật: chăm sóc khách hàng, viết nội dung, code, phân tích.

Mỗi câu hỏi được hỏi nhiều lần ở các mức “sáng tạo” khác nhau để lấy nhiều phương án trả lời, sau đó dùng một hệ chấm điểm để chọn câu tốt nhất theo tiêu chí rõ ràng: đủ ý, đúng tone, đúng format.

Ví dụ một câu “Khách yêu cầu hoàn tiền vì sản phẩm lỗi”, họ sẽ giữ câu trả lời có cấu trúc chuẩn: xin lỗi → hướng dẫn xử lý → kết thúc bằng hành động cụ thể.

Khi bước vào huấn luyện, model nhỏ chỉ cần học lại mapping đã được “tinh chế” này. Với các bài toán nhiều bước, họ cho model lớn giải theo nhiều cách, chọn lời giải cho kết quả ổn định nhất rồi đưa vào dữ liệu. Model nhỏ học lại pattern đó nên vẫn giữ được logic cơ bản.

Ví dụ bài toán tính chi phí đơn hàng sau giảm giá và phí ship, model nhỏ sẽ tái tạo đúng thứ tự tính toán đã được chọn từ model lớn.

Đánh giá chất lượng được gắn trực tiếp với bài toán thực tế. Với code thì đo pass@k, tức là chạy có đúng không; với hỏi đáp thì đo exact match hoặc F1; với nội dung thì so trực tiếp câu trả lời giữa model nhỏ và model lớn để tính win-rate.

Ví dụ đưa 100 câu hỏi support, nếu model nhỏ được chọn tốt hơn 60 lần thì win-rate là 60%. Song song đó, họ đo độ ổn định: cùng một câu hỏi, model có trả lời nhất quán hay không, và đo calibration để xem mức độ tự tin có khớp với độ chính xác.

Khi đưa vào sản phẩm, họ không dùng một model duy nhất mà chia việc theo chi phí. Model nhỏ xử lý phần lớn câu hỏi phổ biến vì rẻ và nhanh, còn những câu phức tạp sẽ được chuyển sang model lớn.

Ví dụ một hệ thống chăm sóc khách hàng có thể để 80% câu hỏi như “Đơn hàng ở đâu?”, “Đổi trả thế nào?” cho model nhỏ xử lý, và chỉ đẩy các trường hợp tranh chấp thanh toán lên model lớn. Với cấu trúc này, chi phí trung bình giảm mạnh trong khi trải nghiệm vẫn ổn định.

Một bước tối ưu sâu hơn là nén cả workflow. Một agent nhiều bước trước đây phải đọc dữ liệu, phân tích, viết, kiểm tra rồi chỉnh sửa. Họ log toàn bộ input và output cuối, sau đó train model nhỏ học trực tiếp kết quả.

Ví dụ từ yêu cầu “Viết báo cáo tuần từ dữ liệu này”, model nhỏ trả luôn báo cáo hoàn chỉnh trong một bước, không cần chạy qua nhiều vòng suy luận. Độ trễ giảm và chi phí cũng giảm theo.

Về kinh tế, cách này tạo ra chênh lệch rất lớn. Model lớn đạt chất lượng cao nhưng chi phí cao, còn model chưng cất đạt khoảng 70–90% hiệu năng trong các tình huống lặp lại với chi phí chỉ bằng một phần nhỏ. Đây là lý do vì sao các model Trung Quốc có thể rẻ hơn nhiều nhưng vẫn dùng tốt trong phần lớn use case.

Toàn bộ hệ thống vận hành xoay quanh bốn điểm: dữ liệu được thiết kế đúng phân phối sử dụng, loss tối ưu để giữ hành vi của model lớn, đánh giá sát với bài toán thật, và routing để cân bằng chi phí – chất lượng.

Vừa có kinh nghiệm & vừa có kiến thức. Follow @nghienaivn ở đây nè 👇

https://t.co/wOX7GsW3qv

---

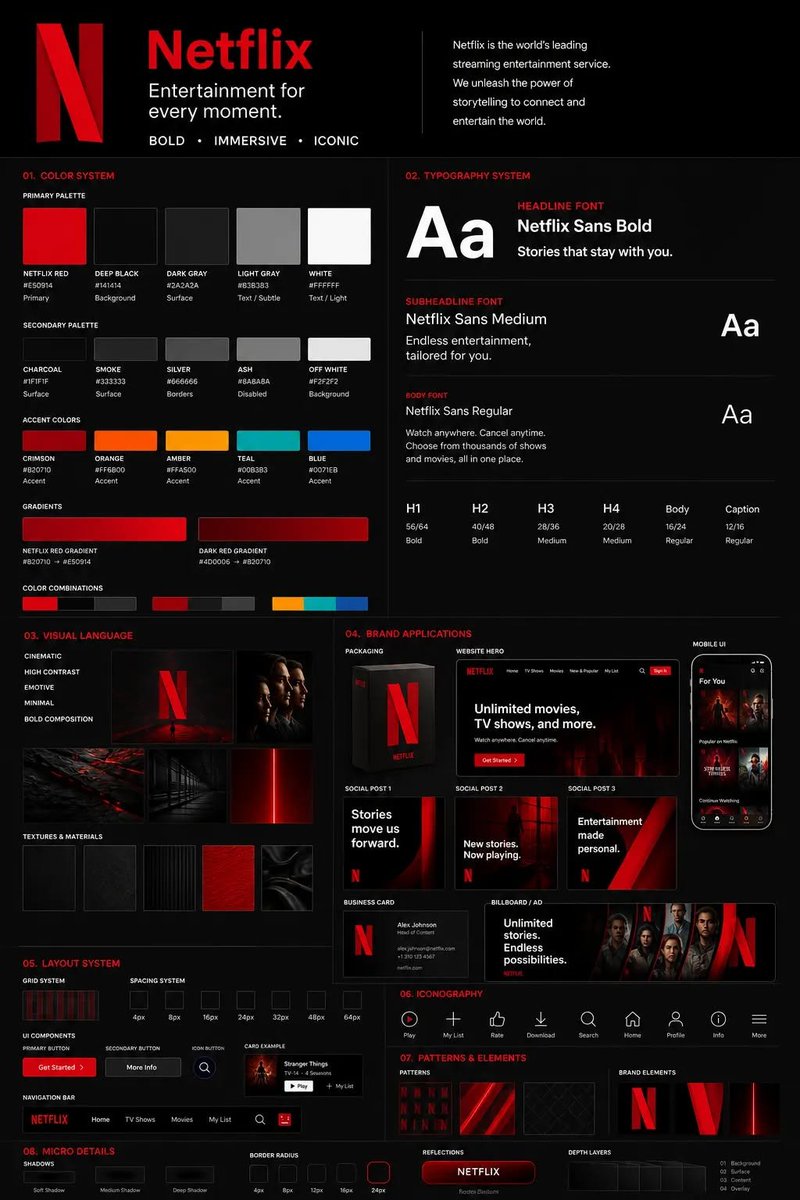

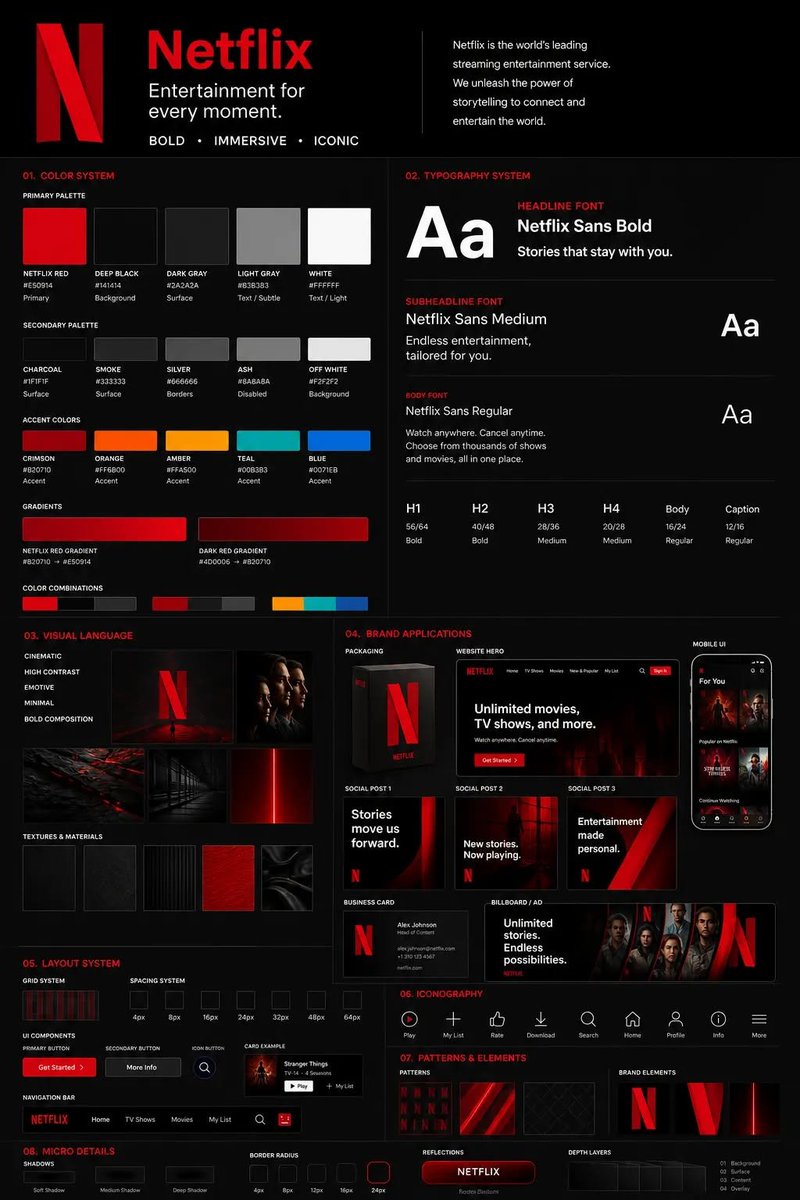

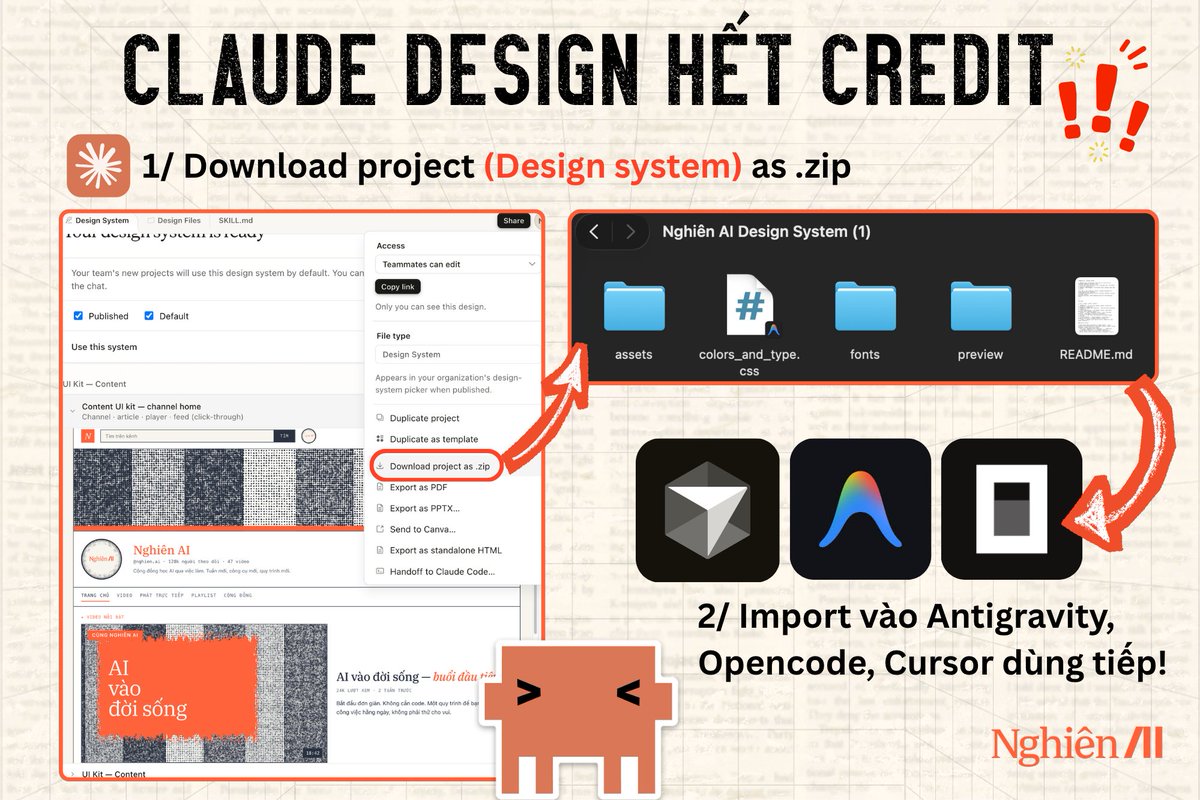

Giải quyết vấn đề bí ý tưởng cho design system (design.md) với app này 👇

Có hơn 2.000 file DESIGN.md được trích ra từ các sản phẩm top.

Trong đó đã có sẵn:

- Màu sắc (colors)

- Kiểu chữ (typography)

- Khoảng cách (spacing)

- Quy tắc component

Tất cả được đóng gói trong một file Markdown .md duy nhất để AI đọc trước khi nó generate bất kỳ thứ gì.

Dùng được với Claude Code, Cursor, Lovable, Bolt. Miễn phí 100%.

À nhưng mình thấy mấy cái liên quan tới design thì gửi Codex hoặc Claude là ổn nhất, gửi cho mất model Trung Quốc nó design không đẹp, bị nhiều lỗi 😁

Toàn bộ các app mình dùng cho design.md

1/ https://t.co/3UdVSi5iuy

2/ https://t.co/2d4aecS601

3/ https://t.co/SU0eINX5JU

4/ https://t.co/cL1awScEqo

5/ https://t.co/bhFLgYewl9

6/ https://t.co/sNV6EcI7VA

Chúng anh em thiết kế đẹp 😁

Follow @nghienaivn để thay đổi hoàn toàn workflow với AI: https://t.co/wOX7GsW3qv

Nguồn: dr_cintas

✅ Làm slide với tool này tiện ghê

Nếu như cần tạo slide nhanh để present, các bạn có thể dùng Claude/Codex luôn nhưng nhược điểm là nó không thể edit các element như edit chữ, edit màu, căn chỉnh tỷ lệ trực tiếp trên HTML slide sau khi đã tạo ra rồi.

Mỗi lần prompt chỉnh lại cũng kha khá thời gian.

Nhưng project dưới đây fix vấn đề đó. Ví dụ như mình đã có 1 bài viết về "AI Engineering Framework" và cần nó tạo slide để thuyết trình. Nó tạo luôn cho mình 8 slide (chỗ này mình chưa prompt kỹ nên nội dung còn sơ xài lắm).

Sau đó muốn edit màu, nội dung (như dưới video) thì nó mở luôn cái app localhost để edit khá tiện.

Link Github Repo & hướng dẫn 👇

Bắt đầu từ link GitHub, bạn chỉ cần đưa thẳng cho Claude hoặc Codex kèm một yêu cầu rõ ràng: “clone repo này, cài dependency, chạy dev server và báo lại khi mở được trên localhost”. Agent sẽ tự đọc README, tự chạy init, cài gói và mở project.

https://t.co/9G0nYH7tEW

Khi nó báo đã chạy xong, bước tiếp theo là đưa nội dung để nó làm slide. Cách hiệu quả nhất là gửi trực tiếp một bài viết hoặc nội dung thô kèm yêu cầu cụ thể, ví dụ: “chuyển nội dung này thành 10 slide, mỗi slide một ý chính, tiêu đề ngắn, ít chữ, ưu tiên trình bày trực quan”.

Nếu bạn có sẵn cấu trúc thì đưa luôn, ví dụ chia rõ phần mở đầu, vấn đề, insight, giải pháp, vì agent sẽ bám vào đó để dựng deck chính xác hơn thay vì tự đoán.

Ví dụ:

Slide 1: Hook

Slide 2–4: Problem

Slide 5–8: Insight

Slide 9–12: Solution

Sau khi nó tạo xong, bạn mở giao diện slide trên trình duyệt, click vào từng phần và ghi comment kiểu “đổi màu đoạn này”, “rút ngắn câu này”, “headline mạnh hơn”.

Quay lại agent và yêu cầu nó áp dụng toàn bộ comment, nó sẽ sửa trực tiếp trong code và cập nhật lại slide. Bạn lặp lại vòng này vài lần là ra bản hoàn chỉnh.

---

Follow @nghienaivn để học nhiều tip hay về AI

💯 https://t.co/wOX7GsW3qv

----

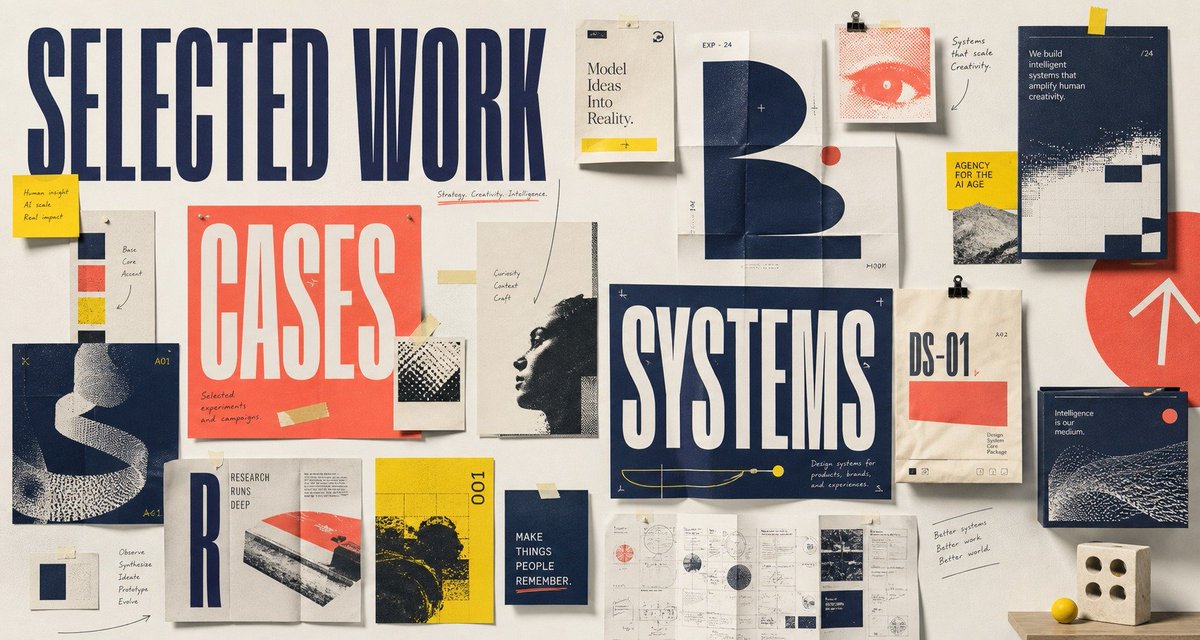

🖼️ Vừa nhờ AI làm poster cho brand Nghiên AI @nghienaivn nhưng phá cách hơn và đây là kết quả

Công nhận trí tưởng tượng của ChatGPT Image 2.0 bay xa thật 😁

PROMPT 👇

"https://t.co/Pq4D7TiCWt

Based on the skill above, generate images for a website for an AI agency. The design should include eight sections, with one image per section, for a total of eight distinct images.

The website is for a creative AI company focused on research in creativity and design. Because of that, I want the visuals to feel highly original, playful, and art-directed, with text integrated thoughtfully into the design. Make it feel ultra-creative and intentional, like an Awwwards SOTD-level website in both concept and execution.

Please go beyond standard layouts. Do not rely only on simple text-left, image-right compositions. Explore more experimental and varied layouts. Feel free to go completely wild, but keep it purposeful, not random. I want different section structures, including horizontal images, fullscreen sections, full background imagery, and more minimal sections with beautiful colors and a strong sense of motion or animation.

Please use full background images or strong full-background color compositions, not just plain white sections. Keep it in light mode.

Overall, try to stay somewhat consistent across the site while still making each section feel distinct. I want it to look crazy creative, thoughtful, and visually impressive, with strong UX and a clear sense of purpose.

Generate 8 different images total.

Do not combine them into one image.

Each image should represent one section of the website."

----

Nhưng trước khi dán prompt dưới đây, bạn cần có mô tả sơ bộ thương hiệu của bạn là gì? Tông màu chủ đạo là gì? Thương hiệu làm ngành gì? để nó có hình dung trước rồi mới làm được nha 😁

Follow @nghienaivn để bắt kịp AI trong 2 tháng

🟠 https://t.co/wOX7GsW3qv

----

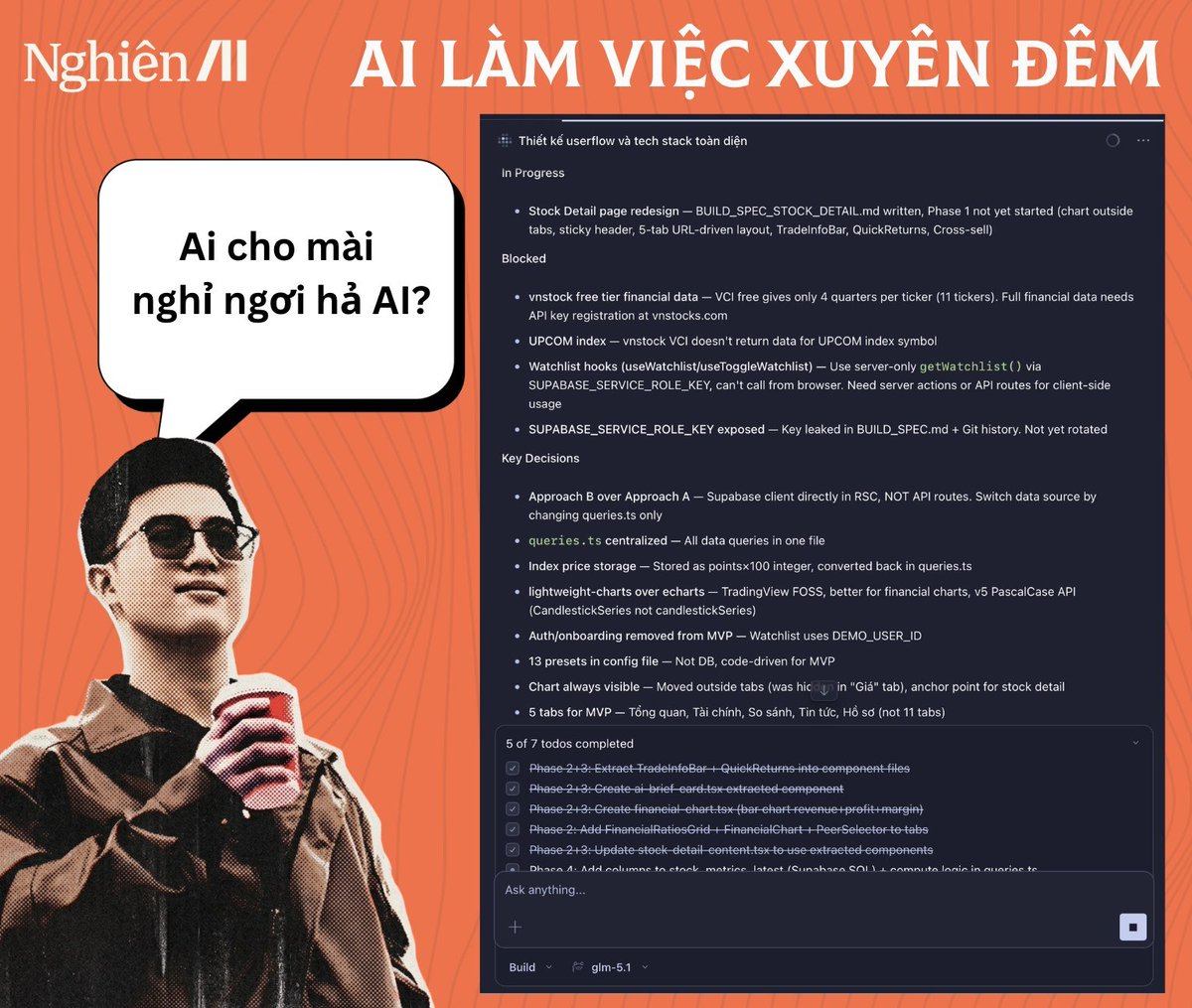

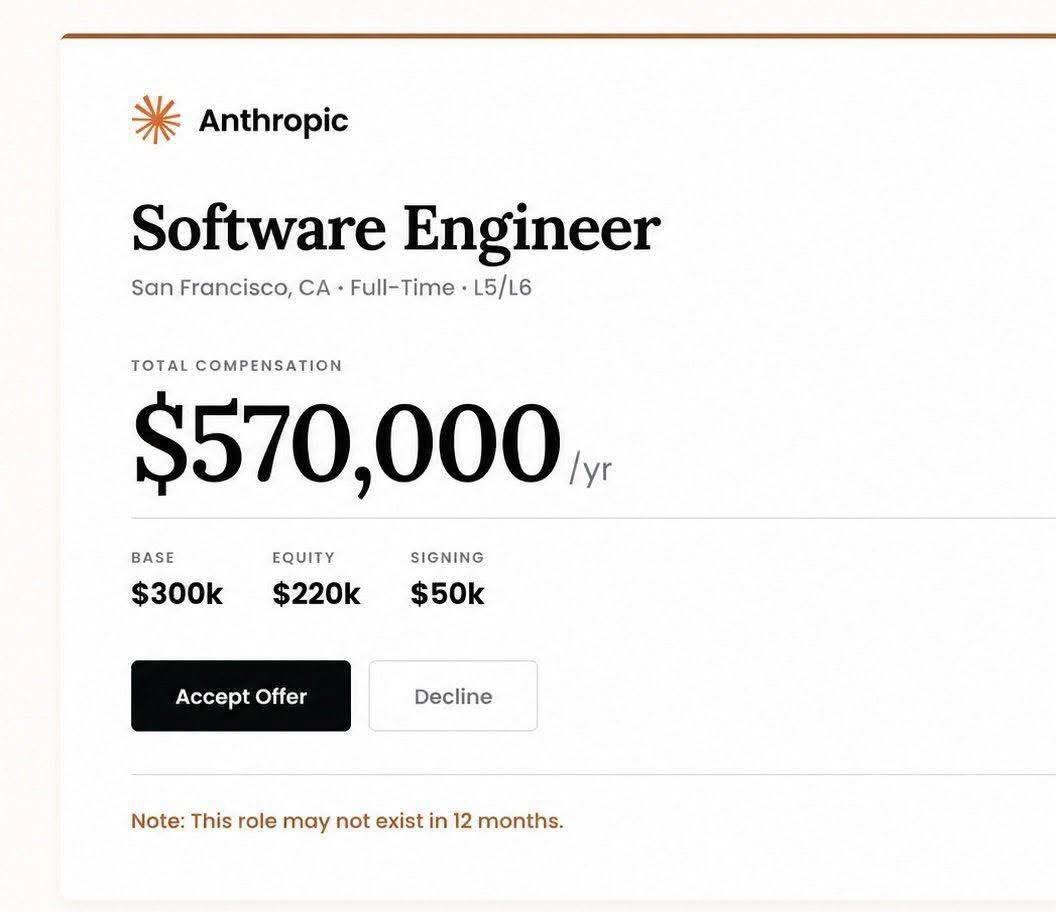

Làm thế nào để AI làm việc xuyên đêm trong lúc mình đi ngủ? 🛌💤

Hôm bữa mình có chia sẻ mình cắm máy cho AI cày cả đêm với combo Opencode + Ollama Cloud AI API thì nhiều anh em có hỏi cách setup nên mình viết bài này share mọi người tham khảo 😁

Để AI làm được điều này bạn cần vài thứ sau

1. Máy không tắt (Phải chỉnh chế độ ngăn nó đi ngủ nếu bạn dùng Laptop)

2. AI Model support phục vụ làm task dài (Cái này mình dùng model GLM 5.1 của Trung Quốc, chuyên build cho task dài luôn. Chứ dùng model khác cắm vào thì nó cứ 15 phút là dừng lại hỏi ngu 🥹)

3. Bạn phải cung cấp cho nó đủ công cụ, context, workflow.

- Cái số 3 là cái khó nhất. Bữa trước mình có viết bài về cách yêu cầu AI hỏi mình 100-200 câu hỏi trước khi build 1 app, 1 tính năng nào đó.

- Yêu cầu nó pop-up interaction box thể mình chọn các option, cái nào không biết thì mình gõ "cần tư vấn theo nhu cầu... abc xyz của tôi".

- Hãy yêu cầu nó đặt câu hỏi về tech stack, UI UX, userflow,... tất cả mọi thứ. Tip để biết bạn hỏi đủ số lượng chưa là lúc nó hỏi 10 câu thì hết 8 câu bạn không biết phải trả lời và cần tư vấn.

- Khi nó tư vấn xong => bạn chọn xong option thì đó là lúc nó đã làm rõ được plan trước khi build.

4/ Sau khi đã hoàn thành plan thực thi dạng file .md. Bạn hãy yêu cần nó viết plan đánh giá & test sau khi thực thi luôn rồi chuyển từ chế độ Plan Mode sang Build Mode rồi cho nó chạy thôi.

À quên, cái quan trọng nhất là tài khoản phải có đủ token cho nó đốt 😁

Anh em còn cách nào hay hơn không ạ? Ví dụ như nhiều Agent làm việc và feedback cho nhau chẳng hạn, cái này nghe lý thuyết nhiều nhưng chưa áp dụng thử. Xin được chỉ giáo ạ 🙌

Follow @nghienaivn để xoá mù AI trong 2 tháng

🫶 https://t.co/wOX7GsW3qv

-----

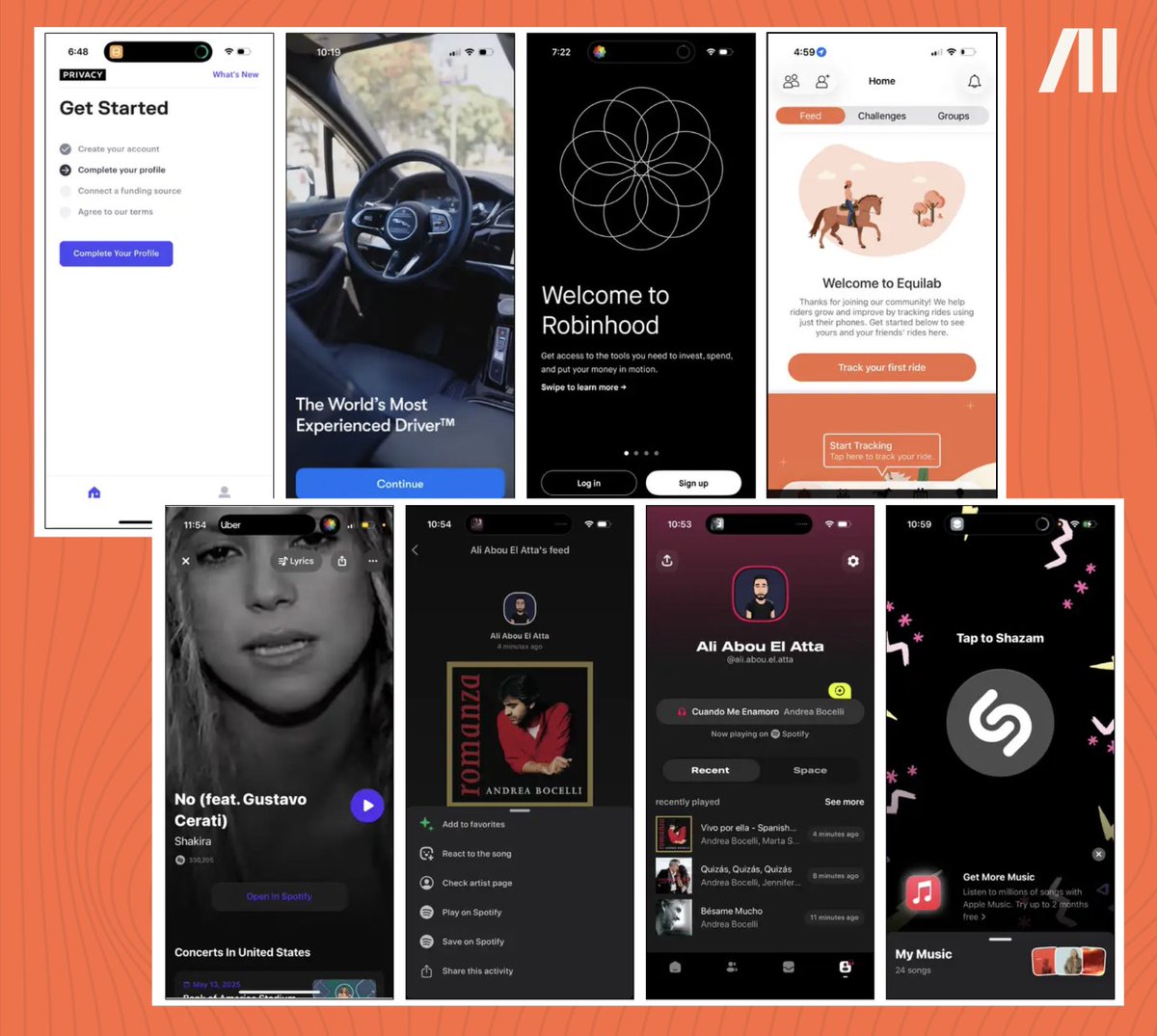

✅ [Hữu ích] Đừng để AI tự bịa userflow! App này sẽ giải quyết vấn đề đó!

Cái này đáng dùng vì nó giải quyết đúng vấn đề lớn nhất khi làm design với AI: thiếu dữ liệu thực tế.

Thay vì để AI tự “nghĩ” ra UI theo kiểu chung chung, bạn có thể cho nó xem hàng trăm nghìn màn hình app thật, phân tích cách các công ty đang làm, gom lại thành pattern, chỉ ra cái nào hiệu quả, cái nào nên tránh rồi đưa ra gợi ý rất cụ thể kèm ví dụ.

Bạn còn có thể kéo nhanh reference, so trực tiếp design của mình với các sản phẩm top hoặc lấy ý tưởng từ những ngành hoàn toàn khác để tránh bị lặp lại.

Điểm hay nữa là nó có sẵn thư viện user flow rất lớn từ onboarding, đăng ký, đăng nhập, permission, settings, profile cho đến các flow quan trọng như search, paywall, checkout, dashboard, chat, review… và có MCP luôn nên AI agent và người xem có thể hiểu luôn cả hành trình người dùng chứ không chỉ từng màn hình riêng lẻ.

🟠 Web đây nè https://t.co/tQ06H8vVSr

Còn muốn cho AI Agent research để sử dụng thì copy prompt ở đây: https://t.co/5uwsr8SneZ

Follow @nghienaivn để biết thêm nhiều tips hữu ích để vibecode đúng hướng với AI 👇

https://t.co/wOX7GsW3qv

----

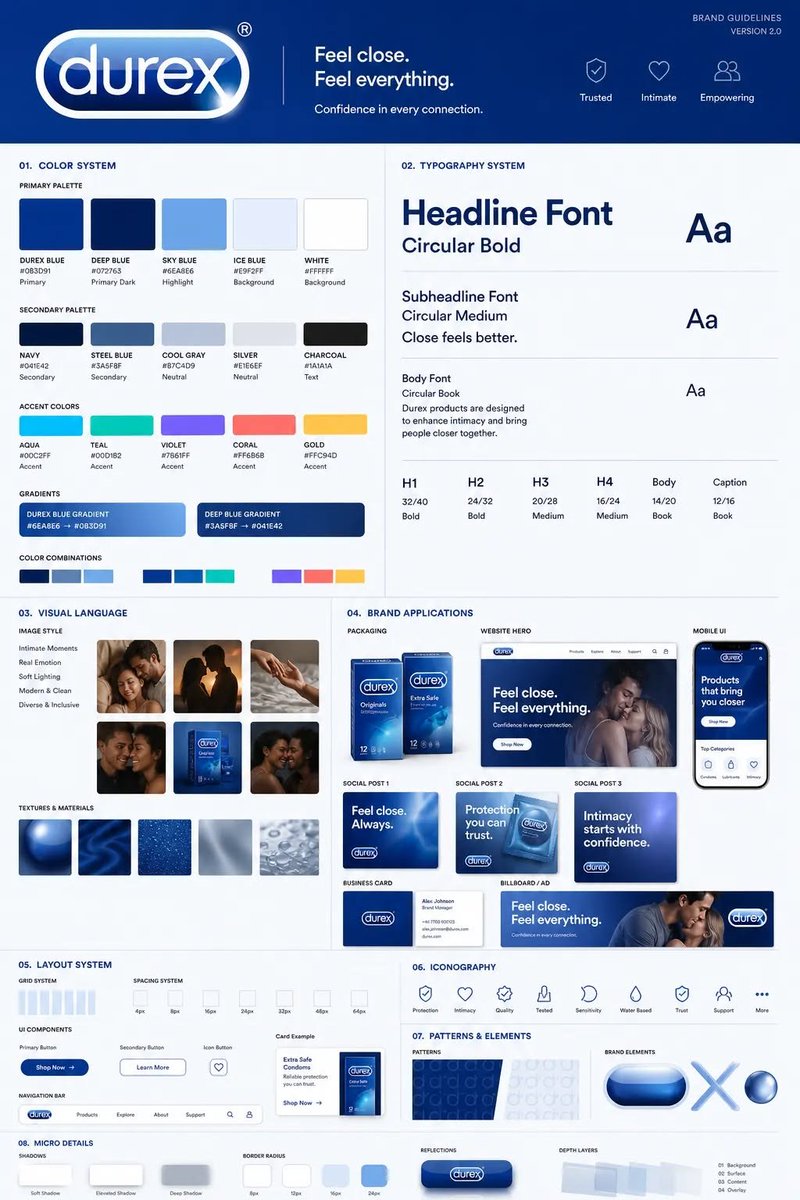

[Prompt bóc tách một thiết kế brand] Từ “wow đẹp” → “à hiểu rồi”

Đây là cách mình hay làm khi thấy một brand quá đẹp: không chỉ nhìn cho “đã mắt” mà sẽ cố dịch nó về dạng system (kiểu design.md) để hiểu nó đang vận hành như thế nào, màu dùng để làm gì, font dùng ở đâu, spacing ra sao, layout lặp lại theo pattern gì. Kiểu như thay vì học cảm tính, mình biến nó thành thứ có thể reuse được.

Cái hay là nó giúp mình rút ngắn rất nhiều thời gian “mò mẫm”, đặc biệt nếu bạn đang build nhanh sản phẩm kiểu vibecode - cần một thứ đủ tốt, đủ sạch, deploy được luôn.

Nhưng nếu nghĩ nó là cách để “tái tạo brand” thì hơi ảo 😄 Vì một brand mạnh không nằm ở UI, mà nằm ở những quyết định phía sau UI: họ chọn nói chuyện với ai (ICP), nói bằng giọng gì (tone), muốn người ta nhớ mình như thế nào (positioning), và họ kiên định với điều đó bao lâu. Mấy thứ này không thể nhìn screenshot mà hiểu hết.

Nên cách dùng hợp lý hơn là coi nó như một lớp hỗ trợ ban đầu:

- Tìm pattern lặp lại (spacing, hierarchy, component logic)

- Hiểu màu đó đang đóng vai trò gì trong hệ thống

- Hiểu flow người dùng mà layout đó phục vụ

Sau đó, layer thêm context của bạn vào:

- Sản phẩm của mình phục vụ ai?

- Hành vi chính là gì?

- Cần cảm giác “tin tưởng”, “nhanh”, hay “premium”?

Rồi từ đó biến cái học được thành system của riêng mình. Nếu làm tới nơi tới chốn hơn một chút, bạn có thể:

gom lại thành 1 “Company design.md” (color, type, spacing, components, tone)

- thêm ví dụ good/bad để system tự học

- test trực tiếp trên landing / UI thật

- cải tiến liên tục (vì design system không phải thứ build 1 lần là xong)

Lúc đó, bạn có bộ khung đủ tốt để build sản phẩm nhanh mà vẫn có gu.

PROMPT phía dưới 👇

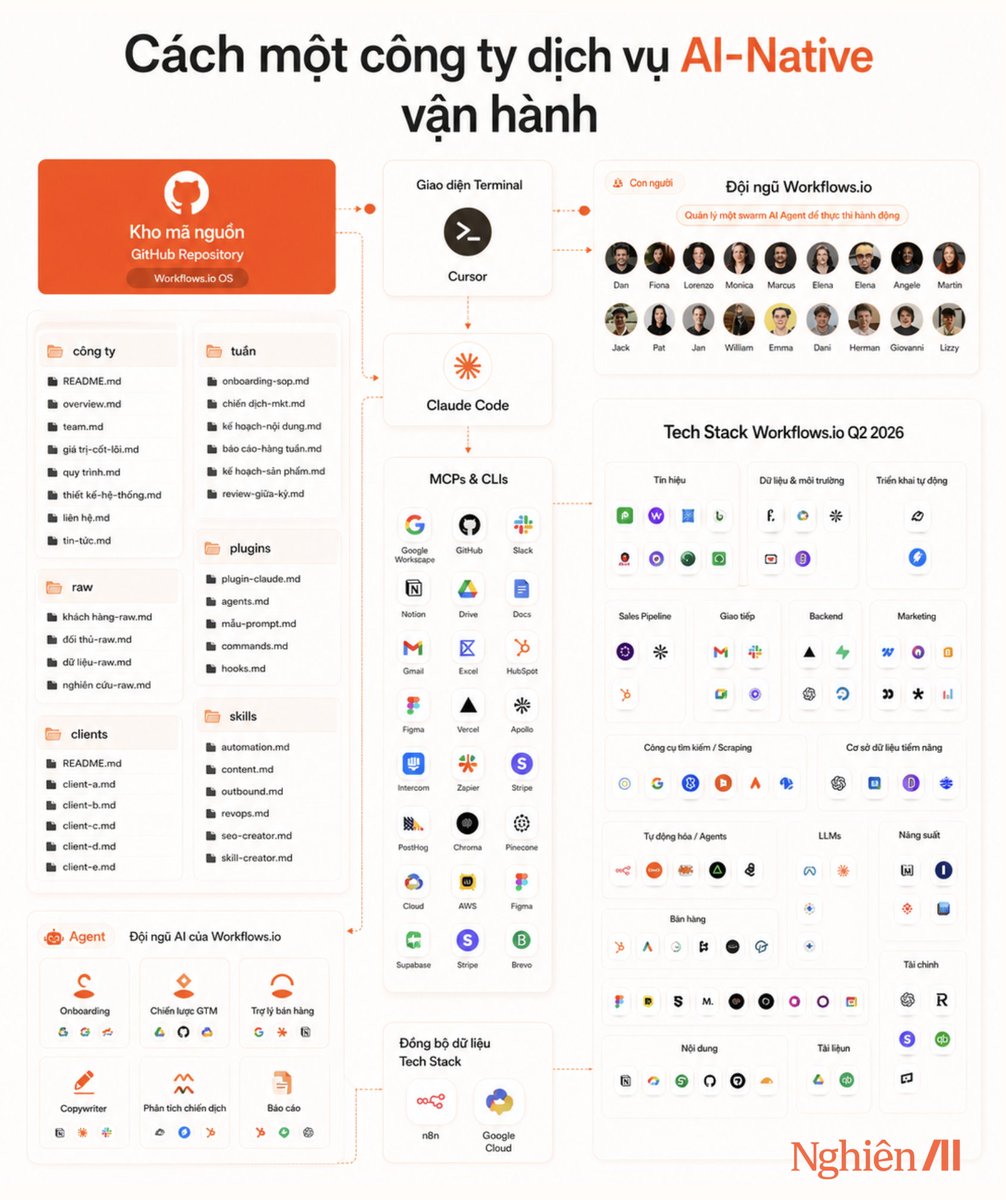

💯 Đây là cách công ty AI native vận hành - Chia sẻ bởi CEO của https://t.co/vzjJqiMtcs

Ông CEO của https://t.co/vzjJqiMtcs chia sẻ về cách họ vận hành một công ty AI-native, anh em đọc thử xem có áp dụng được gì không 😁

Điểm khác biệt lớn nhất là họ không dùng AI như một tool phụ trợ, mà thiết kế lại toàn bộ cách làm việc xoay quanh AI ngay từ đầu. Kiểu không phải “dùng thêm AI cho nhanh”, mà là build cả hệ thống để AI có thể làm việc cùng team.

Toàn bộ dữ liệu công ty được gom vào một repo GitHub gọi là “Company OS”. Trong đó có đủ thứ: tài liệu nội bộ, SOP, playbook, dữ liệu thị trường… Mỗi client cũng có một repo riêng, chứa toàn bộ context như brand, campaign, lịch sử làm việc. Nhờ vậy, mỗi lần làm việc với Claude là đã có sẵn context, không cần ngồi giải thích lại từ đầu.

Thay vì làm việc qua mấy cái UI SaaS như bình thường, họ chuyển dần sang dùng Claude Code + CLI + MCP. Nghe hơi technical nhưng hiểu đơn giản là AI không chỉ “gợi ý” nữa, mà có thể trực tiếp làm việc: đọc file, sửa dữ liệu, chạy workflow, kết nối với Slack, Google Docs, Airtable… Lúc này AI không còn đứng ngoài nữa, mà tham gia luôn vào hệ thống vận hành.

Các việc lặp lại như onboarding khách hàng, research nội dung, xử lý phản hồi hay kiểm tra campaign trước khi chạy thì gần như để AI làm hết. Con người tập trung vào mấy phần quan trọng hơn như strategy với creative. Nhờ vậy team không cần tăng người quá nhiều mà vẫn scale được.

Một điểm mình thấy khá hay là hệ thống này tự cải thiện theo thời gian. Team có thể thêm agent, skill, chỉnh workflow thông qua pull request như code bình thường. Đồng thời dữ liệu từ quá trình làm việc cũng được đẩy ngược lại để AI học tiếp. Càng dùng lâu thì hệ thống càng “khôn” hơn.

Mời các bạn join @nghienaivn tại đây, có nhiều bài viết xịn, anh em cộng đồng support xịn 😁

https://t.co/wOX7GsW3qv

Vibecoder mới build app, build web

Vui lòng không hỏi tech stack phía dưới

Hỏi Claude á chứ tui không biết gì hết! 😁

Meme để câu tương tác vậy thôi chứ cũng phải ráng tìm hiểu anh em ơi, chứ không mấy ông dev cười vào mặt 😁

📌HTML là phần tạo “khung xương” cho website. Nó quyết định trên trang có những gì, ví dụ như tiêu đề, đoạn văn, hình ảnh, nút bấm, form điền thông tin. Nếu ví website như một căn nhà thì HTML là phần tường, cửa, phòng ốc cơ bản.

📌CSS là phần làm cho website đẹp hơn. Nó quyết định màu sắc, font chữ, khoảng cách, bố cục, kích thước… HTML tạo ra cái nút, còn CSS làm cái nút đó có màu cam, bo góc, nhìn đẹp và đúng brand.

📌JavaScript là phần giúp website có tương tác. Ví dụ bạn bấm nút thì hiện popup, kéo xuống thì có animation, nhập form thì kiểm tra đúng sai, hoặc web tự tải thêm dữ liệu. Nói đơn giản, JavaScript làm cho website “biết phản ứng” với hành động của người dùng.

📌React.js là một công cụ dùng JavaScript để làm giao diện web hiện đại hơn. Thay vì viết một trang dài rối rắm, React giúp chia giao diện thành nhiều phần nhỏ gọi là component, ví dụ header, menu, card sản phẩm, nút bấm. Nhờ vậy web dễ sửa, dễ mở rộng hơn.

📌PHP là ngôn ngữ thường dùng để xử lý phần phía sau của website. Người dùng không nhìn thấy phần này, nhưng nó lo những việc như đăng nhập, lưu dữ liệu, gửi form, lấy bài viết từ database. Nhiều website lớn, đặc biệt là WordPress, vẫn dùng PHP.

📌Laravel là framework của PHP, hiểu đơn giản là bộ công cụ giúp viết PHP nhanh và có tổ chức hơn. Thay vì tự làm mọi thứ từ đầu, Laravel có sẵn nhiều phần như đăng nhập, phân quyền, kết nối database, định tuyến trang… nên dev build backend nhanh hơn.

📌DSA là viết tắt của Data Structures & Algorithms, tức là cấu trúc dữ liệu và giải thuật. Nghe hơi học thuật, nhưng hiểu đơn giản là cách sắp xếp và xử lý dữ liệu sao cho hiệu quả. Cái này quan trọng khi cần tối ưu hệ thống hoặc đi phỏng vấn dev.

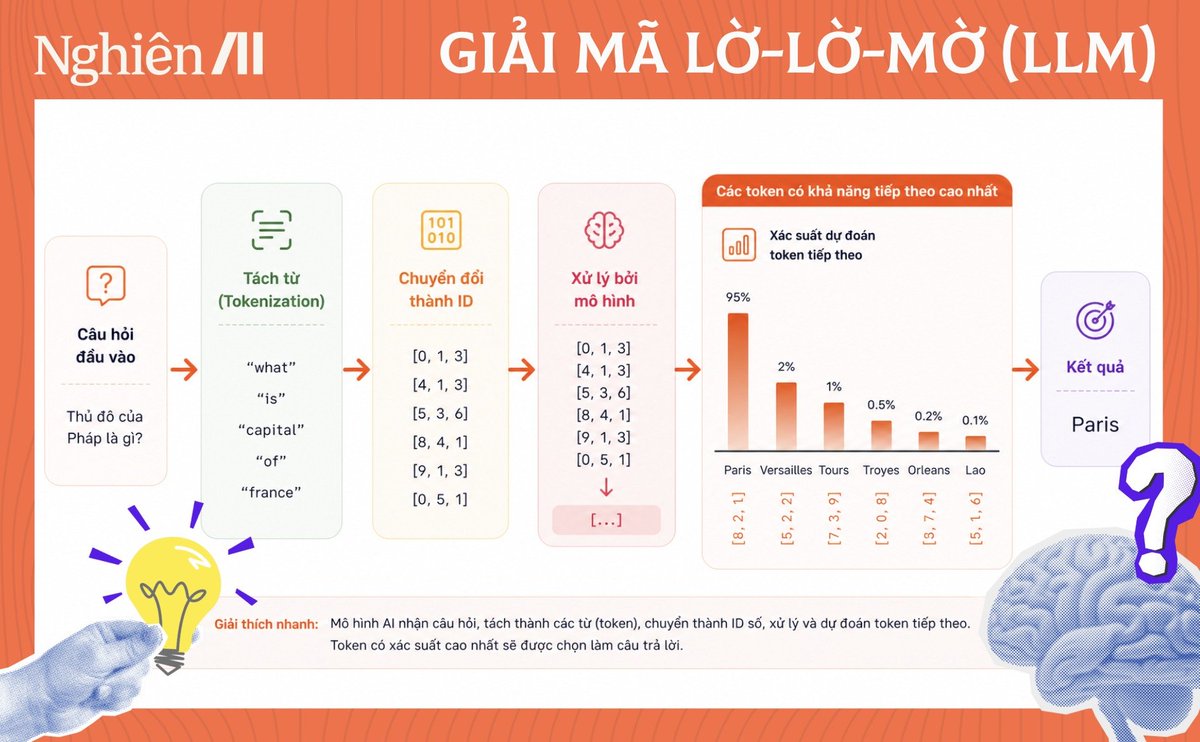

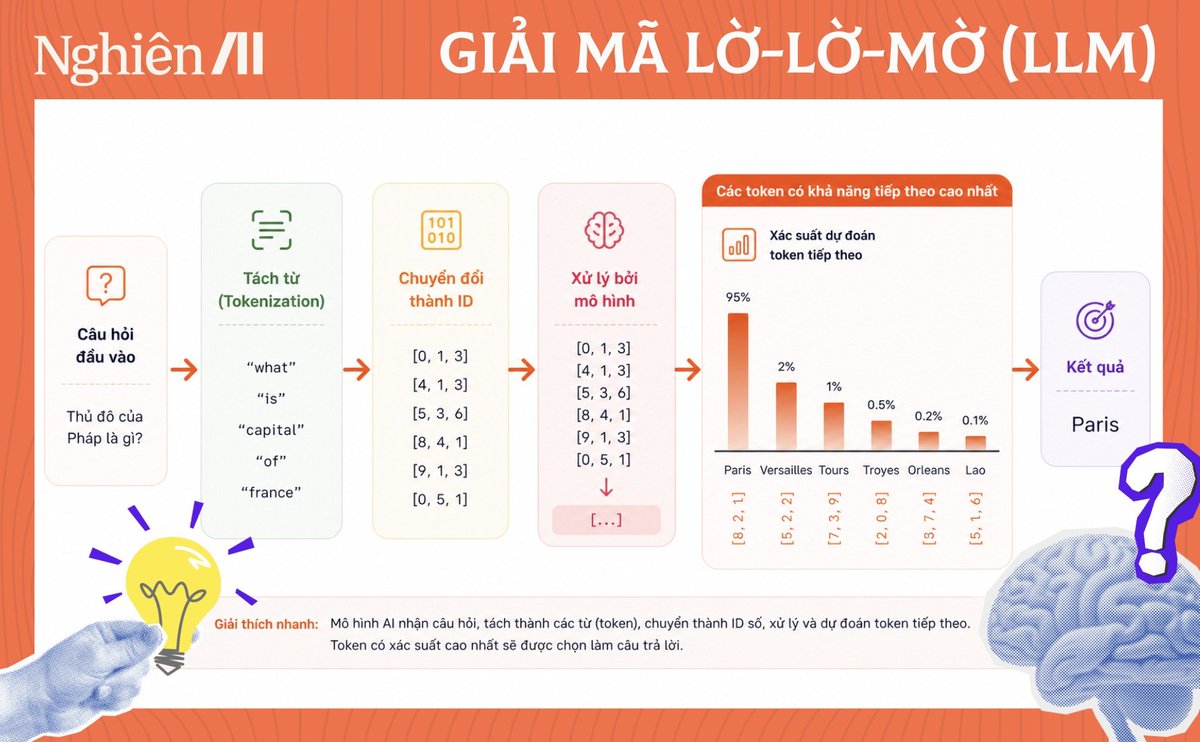

🧠 LỜ-LỜ-MỜ (LLM)... LÀ CÁI QUÁI GÌ THẾ?

Trải nghiệm từ App nhưng vẫn nên có kiến thức từ nền tảng lên. Thôi hôm nay mình học 1 từ khoá nha 😁

Con AI này không biết gì hết… nhưng vẫn nói chuyện như chuyên gia

Nếu nói cho dễ hiểu, Large Language Model giống như một đứa “đọc gần hết internet”, nhưng công việc duy nhất của nó là dự đoán phần tiếp theo của câu. Trong AI gọi là next token prediction.

Ví dụ rất cơ bản trong bài gốc: “The cat sat on the ___”, nó điền “mat” vì trong dữ liệu nó đã học, câu này gần như luôn kết thúc như vậy.

Bạn thử đổi sang tiếng Việt: “Hôm nay trời rất ___”, nó sẽ điền “đẹp” hoặc “nóng” tùy ngữ cảnh trước đó. Toàn bộ cái gọi là “trí tuệ” bắt đầu từ việc đoán như vậy, chỉ là được lặp lại hàng tỷ lần.

Nó không đọc chữ như bạn… nó đọc số

Một chi tiết nhiều người không để ý: model không hề thấy chữ. Bạn gõ “hello”, nó thấy một con số. Toàn bộ câu bạn nhập sẽ được tách thành token, rồi qua bước encoding thành số, chạy qua mạng neuron, rồi decoding lại thành chữ .

Ví dụ “cryptocurrency” có thể bị tách thành “crypto” và “currency”. Đây là lý do vì sao nó rất giỏi viết văn, nhưng lại fail mấy câu kiểu “từ strawberry có mấy chữ r”.

Với bạn là chuyện đếm chữ, với nó là xử lý một vài con số không liên quan đến từng ký tự.

Đọc nhiều quá nên viết cái gì cũng giống thật

Khi bạn hỏi “giải thích blockchain”, nó sẽ viết kiểu: blockchain là gì, sau đó nói về block, hash, consensus, rồi kết lại bằng ứng dụng.

Nghe rất giống một bài viết của dân trong ngành. Nhưng thực tế nó chỉ đang ráp lại từ những pattern đã thấy trong hàng triệu bài viết. Nó biết cấu trúc phổ biến của một bài giải thích, nên nó tái tạo lại.

Một ví dụ khác dễ thấy hơn: bạn bảo nó “viết caption bán hàng mỹ phẩm”, nó sẽ tự động viết kiểu cảm xúc, thêm emoji, thêm lời kêu gọi mua.

Nhồi càng nhiều info càng tốt? Sai lầm kinh điển

Một khái niệm quan trọng là context window, tức là lượng thông tin tối đa model có thể “giữ trong đầu” tại một thời điểm. Ví dụ model có 200k tokens context window thì chỉ xử lý được từng đó.

Giả sử bạn đưa cho nó 500,000 token tài liệu, trong đó có một thông tin quan trọng nằm ở giữa, rồi bạn hỏi một câu liên quan đến chi tiết đó. Nghe thì có vẻ chắc chắn nó sẽ trả lời đúng vì đã có đủ data. Nhưng thực tế nó dễ bỏ sót vì bị phân tán sự chú ý.

Ngược lại, nếu bạn chỉ đưa 10,000 token đúng trọng tâm, nó trả lời chính xác hơn nhiều .

Nó không nói dối… nó chỉ “bịa rất hợp lý”

Hiện tượng này gọi là hallucination. Model không tra cứu dữ liệu, không kiểm chứng sự thật, nó chỉ tạo ra câu trả lời nghe hợp lý nhất.

Ví dụ bạn hỏi “Bitcoin là gì”, nó trả lời rất ổn vì thông tin này xuất hiện khắp nơi. Nhưng bạn hỏi “công ty ABC ở Việt Nam gọi vốn bao nhiêu năm 2019”, nếu dữ liệu này hiếm, nó vẫn trả lời và có thể bịa ra một con số kiểu “5 triệu USD” nghe rất hợp lý.

Càng nhiều “não” thì càng khôn… nhưng cũng càng tốn tiền

Bạn hay nghe về parameters, ví dụ 7B, 70B, hay 1T. Đây là số lượng “trọng số” trong model. Bạn có thể hiểu đơn giản là càng nhiều parameters thì model càng học được pattern phức tạp hơn.

Một ví dụ cụ thể: bạn đưa cùng một prompt “viết bài phân tích thị trường crypto”, model nhỏ sẽ viết rất chung chung. Model lớn sẽ biết chia đoạn, đưa luận điểm, phản biện, và giữ mạch logic tốt hơn. Đổi lại, model lớn tốn nhiều compute hơn, chi phí cao hơn và chạy chậm hơn.

Tóm lại là nó là đứa đọc hết internet… nhưng không chịu trách nhiệm về sự thật

Bạn chỉ cần giữ một mental model rất rõ: LLM là hệ thống next token prediction chạy trên token, hoạt động trong một context window giới hạn và được học qua hàng tỷ parameters. Nó cực giỏi tạo ra văn bản nghe hợp lý, nhưng không tự đảm bảo đúng.

Nếu bạn dùng nó để viết content, brainstorm, hoặc code cơ bản, nó rất mạnh. Nhưng nếu bạn dùng nó để lấy số liệu, fact cụ thể mà không kiểm chứng lại, bạn sẽ gặp rủi ro.

🟠Join FB Group của @nghienaivn để xoá mù AI trong 2 tháng!

https://t.co/wOX7GsW3qv

---

💯 Bí mật phía sau tốc độ “ra tính năng mỗi ngày” của Anthropic - Chia sẻ từ Head of Product, Claude Code

Nghe Anthropic ra tính năng gần như mỗi ngày thì dễ nghĩ là do họ có model mạnh hơn. Nhưng theo chia sẻ của Cat Wu, lý do thật ra đơn giản hơn: tốc độ đó đến từ cách họ làm sản phẩm, không phải chỉ từ công nghệ.

Trước đây, một tính năng có thể mất vài tháng để đi từ ý tưởng đến lúc ra mắt. Ở Anthropic, khoảng thời gian này được rút xuống còn vài tuần, thậm chí vài ngày. Nhưng điều quan trọng không phải là “làm nhanh một lần”, mà là rút ngắn vòng lặp học hỏi. Tuần nào cũng có thứ mới đến tay người dùng, tuần nào cũng có phản hồi thật để điều chỉnh. Nói cách khác, họ không chỉ chạy nhanh, mà học nhanh.

Khi tốc độ thay đổi, vai trò của PM cũng khác đi. Trước đây PM lo tài liệu, kế hoạch, phối hợp nhiều bên. Còn ở đây, PM tập trung vào hai việc: đặt mục tiêu thật rõ và loại bỏ những thứ làm chậm đội ngũ. Vì làm AI rất dễ bị lan man nếu không xác định rõ đang giải quyết vấn đề gì, cho ai, thế nào là làm tốt. Nên thay vì quản lý chi tiết, họ giữ hướng đi và đảm bảo không có điểm nghẽn.

Một điểm đáng chú ý là họ không phụ thuộc vào tài liệu dài dòng nữa. Thay vào đó là số liệu và nguyên tắc chung. Mỗi tuần cả đội nhìn vào dữ liệu để biết cái gì đang hiệu quả, cái gì cần cải thiện. Đồng thời, họ có những nguyên tắc rõ ràng về người dùng, ưu tiên và đánh đổi. Nhờ vậy, mỗi người có thể tự quyết định mà không cần chờ phê duyệt, và tốc độ được đẩy lên rất nhiều.

Để ra nhanh, họ chấp nhận một điều mà nhiều đội khác ngại: đưa sản phẩm ra khi chưa hoàn hảo. Nhiều tính năng được công bố dưới dạng thử nghiệm, nói rõ với người dùng đây chưa phải bản hoàn chỉnh. Cách này giúp giảm áp lực phải làm “cho xong rồi mới ra”, thay vào đó là ra sớm, lấy phản hồi rồi cải thiện dần. Với họ, một tính năng chưa hoàn hảo nhưng có người dùng vẫn tốt hơn một thứ hoàn hảo nhưng ra quá muộn.

Quy trình bên trong cũng được làm gọn để không tạo cản trở. Khi kỹ sư thấy một tính năng đã “đủ ổn”, họ có thể đưa lên kênh chung. Từ đó, các bên liên quan như tài liệu, marketing có thể tham gia và phát hành gần như ngay lập tức. Ít bước chờ đợi, ít thủ tục, mục tiêu là không để thứ gì làm chậm việc đưa sản phẩm ra ngoài.

Cách tổ chức đội ngũ cũng khác. Kỹ sư không chỉ viết code mà còn hiểu sản phẩm. Nhiều người có thể tự đi từ phản hồi của người dùng đến xây dựng rồi ra mắt trong thời gian ngắn mà không cần phụ thuộc nhiều vào PM. Vai trò bắt đầu giao thoa, và thay vì tối ưu từng vị trí riêng lẻ, họ tối ưu khả năng mỗi người tự tạo ra giá trị.

Một góc nhìn khá hay là họ sẵn sàng làm những thứ “chưa thật sự tốt”. Nghe có vẻ ngược, nhưng mục đích là để hiểu công nghệ còn thiếu gì. Khi model tốt hơn, họ chỉ cần thay vào là tính năng hoạt động trơn tru. Nhờ vậy, họ luôn đi trước một bước thay vì chờ mọi thứ hoàn hảo rồi mới bắt đầu.

Tất nhiên, làm nhanh cũng có cái giá. Sản phẩm có thể chưa đồng nhất, nhiều tính năng chồng chéo, người mới dùng sẽ hơi khó hiểu. Nhưng họ chấp nhận điều đó, vì trong thế giới AI thay đổi liên tục, chậm lại mới là rủi ro lớn hơn.

Cuối cùng, thứ giữ cho mọi thứ vận hành được là sự rõ ràng về mục tiêu chung. Khi cả công ty cùng hướng về một đích, việc ưu tiên trở nên dễ dàng hơn. Không cần tranh luận quá lâu, chỉ cần hỏi cái nào giúp tiến gần mục tiêu hơn.

Tóm lại, việc “ra tính năng mỗi ngày” không phải vì họ viết code nhanh hơn, mà vì họ sắp xếp lại cách làm để không có gì cản trở việc đưa sản phẩm đến tay người dùng. Và khi việc viết code ngày càng dễ hơn, thứ quan trọng nhất không còn là làm nhanh, mà là chọn đúng thứ để làm.

Follow @nghienaivn để xoá mù AI trong 2 tháng!

https://t.co/wOX7GsVvAX

-----

🦞 Đây là cách "chủ vựa tôm" Openclaw aka Peter Steinberger nghĩ về nghề dev!

Xem talk của ông này xong thấy có một ý khá thấm: dev không còn bị giới hạn bởi việc gõ code nữa, mà bị giới hạn bởi cách mình suy nghĩ. Trước đây ai code nhanh, code giỏi thì có lợi thế. Giờ AI làm gần hết mấy phần lặp lại rồi, nên phần còn lại là bạn nghĩ được gì, đặt bài toán ra sao, và muốn build cái gì.

Ổng có một câu khá hay: chatbot thì bí là đứng, còn agent thì tự xoay cách làm tiếp. Nghe đơn giản nhưng nó đúng với những gì đang xảy ra. AI không còn chỉ trả lời nữa, mà bắt đầu tự xử lý để hoàn thành task. Lúc đó nó không còn giống một cái tool nữa.

Cái mình thấy đáng chú ý hơn là ông này không build cho dev, mà build cho bất kỳ ai muốn làm gì đó. Những case như người không biết code vẫn build được sản phẩm nghe có vẻ hype, nhưng thực tế là barrier đang giảm rất nhanh. Vấn đề không còn là biết code hay không, mà là bạn có idea và có chịu thử không.

Nhìn rộng ra thì nghề dev không biến mất, nhưng cách làm việc đang đổi. Trước đây là viết code để ra sản phẩm. Giờ là nghĩ idea, dùng AI để ra prototype, rồi iterate liên tục. Lúc này người nào thử nhanh hơn, nghĩ rõ hơn sẽ có lợi thế.

AI không thay dev, nó làm cho việc build trở nên dễ hơn. Và khi build trở nên dễ, thì câu chuyện không còn là kỹ năng nữa, mà là cách bạn dùng nó để làm gì.

Follow @nghienaivn for more 👇

https://t.co/wOX7GsW3qv

---

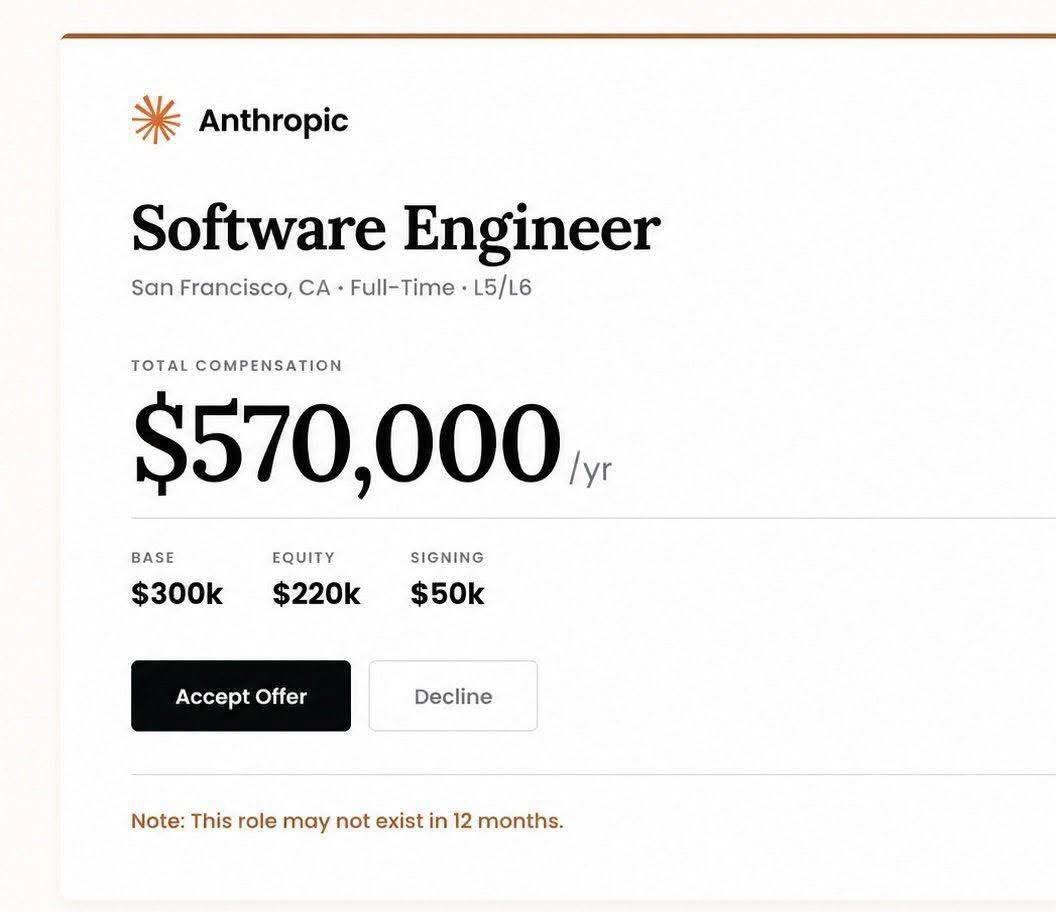

Anthropic tuyển kỹ sư phần mềm thù lao 14 tỷ vnd/năm nhưng note thêm vị trí này có thể KHÔNG TỒN TẠI TRONG 12 THÁNG TỚI 😁

Trước đây thì quen kiểu Junior → Mid → Senior → Lead, còn giờ có khi prompt đúng một cái là output ngang Senior luôn, nên mấy role ở giữa kiểu triển khai, tổng hợp, dịch yêu cầu đang bị nén lại rất nhanh.

Thành ra game bây giờ không còn là làm giỏi hơn người khác, mà là biết cách setup để công việc được làm. AI viết code, AI viết content, AI research, còn mình thì thiết kế workflow, chia task, build agent, nối mọi thứ lại với nhau. Những việc chưa ai làm trước, chưa có quy trình, chưa ai định nghĩa rõ thì lại càng trả cao.

Bạn không chỉ làm việc mà còn phải tự nghĩ xem “công việc này thực ra là gì?”

14 tỷ/năm nghe thì to thật nhưng thực ra họ đang mua tốc độ: test nhanh hơn, fail nhanh hơn, tìm ra cái đúng nhanh hơn.

Câu chuyện này không phải về lương, mà là về việc job đang không còn là thứ cố định nữa, nó giống như một thứ được tạo ra để giải quyết vấn đề, giải quyết xong rồi thì biến mất luôn.

Anthropic tuyển kỹ sư phần mềm thù lao 14 tỷ vnd/năm nhưng note thêm vị trí này có thể KHÔNG TỒN TẠI TRONG 12 THÁNG TỚI 😁

Đang lướt thì thấy cái JD của Anthropic thấy hơi rén 😁 Tuyển Software Engineer lương ~14 tỷ/năm nhưng thêm một dòng note nhẹ: role này có thể không tồn tại trong 12 tháng tới.

Tức là họ không tuyển bạn để “làm lâu dài” mà tuyển bạn để giải một vấn đề cụ thể, giải xong thì job cũng xong luôn.

Nghe hơi vô lý nhưng nghĩ lại thì hợp lý vì càng là những việc chưa ai làm trước, chưa có quy trình, chưa ai định nghĩa rõ thì lại càng trả cao.

Bạn không chỉ làm việc mà còn phải tự nghĩ xem “công việc này thực ra là gì?”.

Cái thú vị là ngay cả Anthropic còn không biết 12 tháng nữa họ có cần role này không, thì mấy cái kiểu “plan career 5 năm” nghe hơi outdated 😅

Trước đây thì quen kiểu Junior → Mid → Senior → Lead, còn giờ có khi prompt đúng một cái là output ngang Senior luôn, nên mấy role ở giữa kiểu triển khai, tổng hợp, dịch yêu cầu đang bị nén lại rất nhanh.

Thành ra game bây giờ không còn là làm giỏi hơn người khác, mà là biết cách setup để công việc được làm. AI viết code, AI viết content, AI research, còn mình thì thiết kế workflow, chia task, build agent, nối mọi thứ lại với nhau.

14 tỷ/năm nghe thì to thật nhưng thực ra họ đang mua tốc độ: test nhanh hơn, fail nhanh hơn, tìm ra cái đúng nhanh hơn. Mất 4 năm học để làm một job mà job đó có thể bay màu trong 12 tháng.

Câu chuyện này không phải về lương, mà là về việc job đang không còn là thứ cố định nữa, nó giống như một thứ được tạo ra để giải quyết vấn đề, giải quyết xong rồi thì biến mất luôn.

🧠 Cách set-up workspace hữu khi khi dùng AI

Hữu ích để tham khảo, không nên áp dụng một cách thụ động!

Quan trọng nhất vẫn là bạn hiểu công việc của chính mình => từ đó suy nghĩ xem AI có thể tham gia ở phần nào để cải thiện Workflow. Nếu tham gia được thì có thể tạo Agent để từng bước tự động hoá không?

Bây giờ mình ưu tiên dùng Claude Code / Codex / Opencode để làm việc local 100% giúp mình không phụ thuộc vào app nào cả. Vì vậy với mỗi project (đại diện cho 1 tác vụ bạn làm hoặc 1 dự án) thì bạn cần set-up làm sao để Agent workspace này hoạt động hiệu quả.

✍️ Prompt để bạn sử dụng đó là:

“Giúp tôi thiết kế một workspace claude.md hoặc agents.md tối ưu cho công việc của tôi. Đừng yêu cầu tôi mô tả dài dòng. Hãy chủ động đặt 50 câu hỏi từng bước (ngắn, rõ, dạng lựa chọn nếu có thể) để hiểu:

- Tôi đang làm công việc gì

- Mục tiêu chính của tôi là gì

- Workflow hiện tại gồm những bước nào

- Những chỗ nào đang tốn thời gian hoặc dễ sai

Sau khi hỏi đủ, hãy:

- Đề xuất cấu trúc folder claude.md hoặc agents.md phù hợp

- Tạo sẵn nội dung cho CLAUDE.md (ngắn gọn, thực tế)

- Gợi ý các skills có thể tái sử dụng

- Nếu cần, chia thành các agent rõ nhiệm vụ

- Đề xuất hooks / rules / output style phù hợp với workflow của tôi

Trả về kết quả có thể dùng ngay, không giải thích lan man.”

Cách này giúp bạn chuyển từ “ngồi nghĩ xem phải setup gì” sang “để AI khai thác ngược lại workflow của bạn”.

Và khi làm đúng, bạn sẽ thấy AI không làm thay bạn, nhưng nó giúp bạn chuẩn hoá và scale cách bạn đang làm nhanh hơn rất nhiều.

Note cho anh em là claude.md (dành cho app Claude) hay agents.md (dành cho AI khác) là như nhau, đây là file đầu tiên mà khi AI sẽ đọc khi bắt đầu công việc nên bạn sẽ cần setup những workflow, quy tắc vào đây trước.

Follow @nghienaivn ở đây để xem thêm nhiều tips hay 💯

https://t.co/wOX7GsW3qv

Pro Tip: Interactive Box cho 100 câu hỏi ✅

Hôm bữa mình có chia sẻ nếu anh chị đang vibecode app nào đó thì hãy yêu cầu nó hỏi 100-200 câu hỏi về project trước khi build để nó hiểu đúng ý bạn.

Có anh chị nhắn hỏi 100-200 câu thì trả lời tới bao giờ?

Tip là anh chị yêu cầu nó hỏi mình dạng Interactive box, có các option để mình chọn, như vậy mới nhanh.

Hãy yêu cầu nó đặt những câu hỏi từ nền tảng lên trên, từ tổng quan đến chi tiết, từ cơ bản đến phức tạp.

Còn những câu bạn không biết chọn cái nào thì cứ gõ: "Cần tư vấn thêm" thì nó sẽ soạn ra câu hỏi để hỏi tiếp!

Đảm bảo App sẽ được build đúng ý mình hơn x100 lầnnn 💯

Nhiều tips hay ở đây nè 👇

https://t.co/wOX7GsW3qv

#NghiênAI 🟠

😍 CẢM ƠN ANH CHỊ EM ĐÃ ĐẾN MEET-UP #1 "CAI" NGHIỆN AI

Meet-up về AI nhưng không nói về công cụ AI mà nói về:

- Cách để không bị phụ thuộc vào AI

- Cách chọn AI đúng với workflow để ra output

- Cách để giữ lại những lại "tài sản" giá trị sau khi làm việc với AI

✅ The AI Principle

⌛ The AI 1st Step (Coming soon)

Buổi sau tụi mình dự định tổ chức kiểu orkshop ngồi vibecode trực tiếp để giải quyết vấn đề của mọi người luôn, trong buổi đó mình sẽ mời dev xịn đến chia sẻ thực chiến 😁

Dự kiến 20-30 slot dành cho anh em đăng ký trước, ít người nhưng giữ chất lượng để đảm bảo ai cũng học được - áp dụng được.

Buổi đó sẽ học được, có tài liệu mang về, có quà từ nhà tài trợ luôn (@nghienaivn đang open để hợp tác ạ 🙌)

Anh em thấy sao? 🤔

✅ The AI Principle

⌛ The AI 1st Step (Coming soon)

Cảm ơn a Bảo dành thời gian join meet-up cùng @nghienaivn 😍

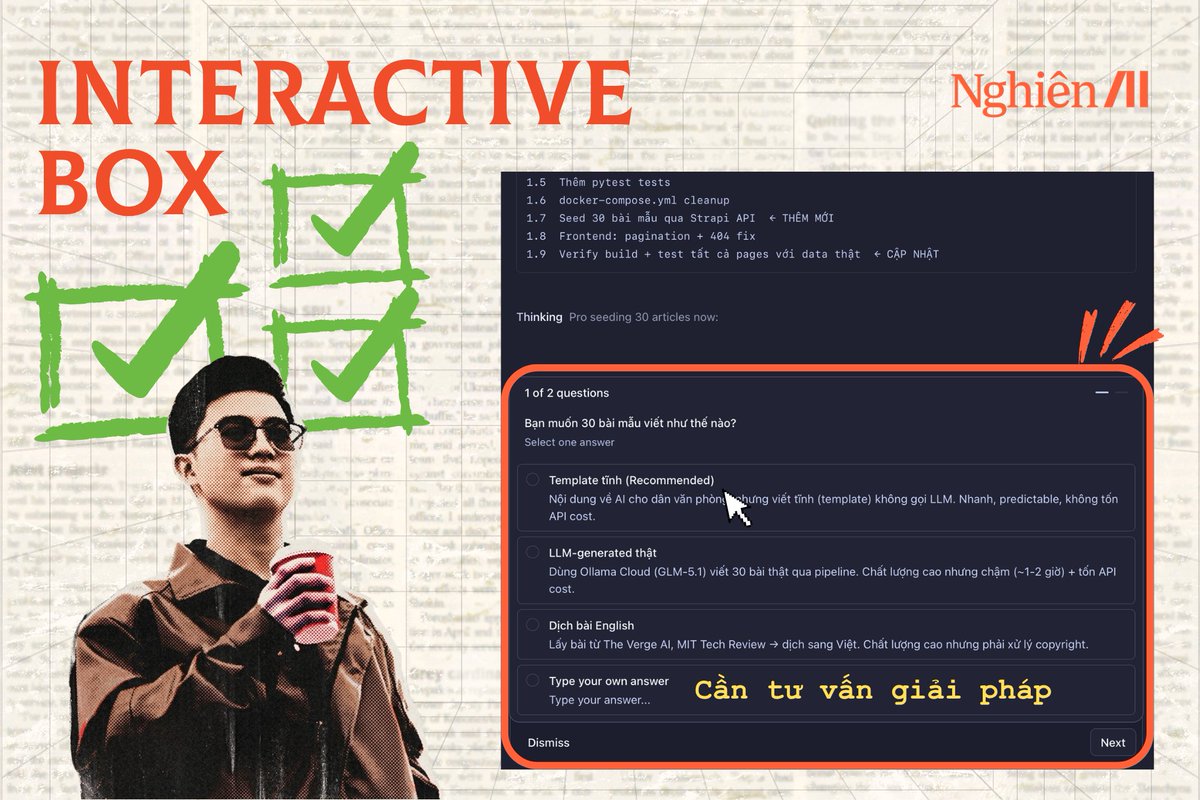

⚠️ Đang xài Claude Design ngon quá mà hết credit thì sao?

May quá Claude cũng thương người, có nút download design system về cho anh em xài tiếp ở Opencode, Antigravity,...

Mặc dù chất lượng không bằng nhưng cũng đỡ hơn phải chờ tới tuần sau 🙌

Group này có nhiều bài xịn về AI 😁

https://t.co/wOX7GsW3qv

---

Cảm ơn mọi người đã yêu quý và ủng hộ Nghiên AI 🫶

Dù chỉ mới đăng được 1-2 bữa nhưng số lượng slot đã sắp full. Hi vọng lần sau síp @khaihoan_ne duyệt budget để chọn cái venue to bằng cái sân banh 😁

Hẹn gặp anh chị em sáng mai ở Nghiên AI Meetup - Cà phê “cai nghiện AI” ☕

Không ai đứng dạy, chỉ chia sẻ thật: AI đang giúp gì, workflow nào đang chạy được, và gặp đúng người cùng hệ 👨💻

Địa điểm đã được cập nhật https://t.co/rJgh07GozR

Anh chị em ở HN, ĐN thì Nghiên AI xin phép hẹn dịp sau nha 😍

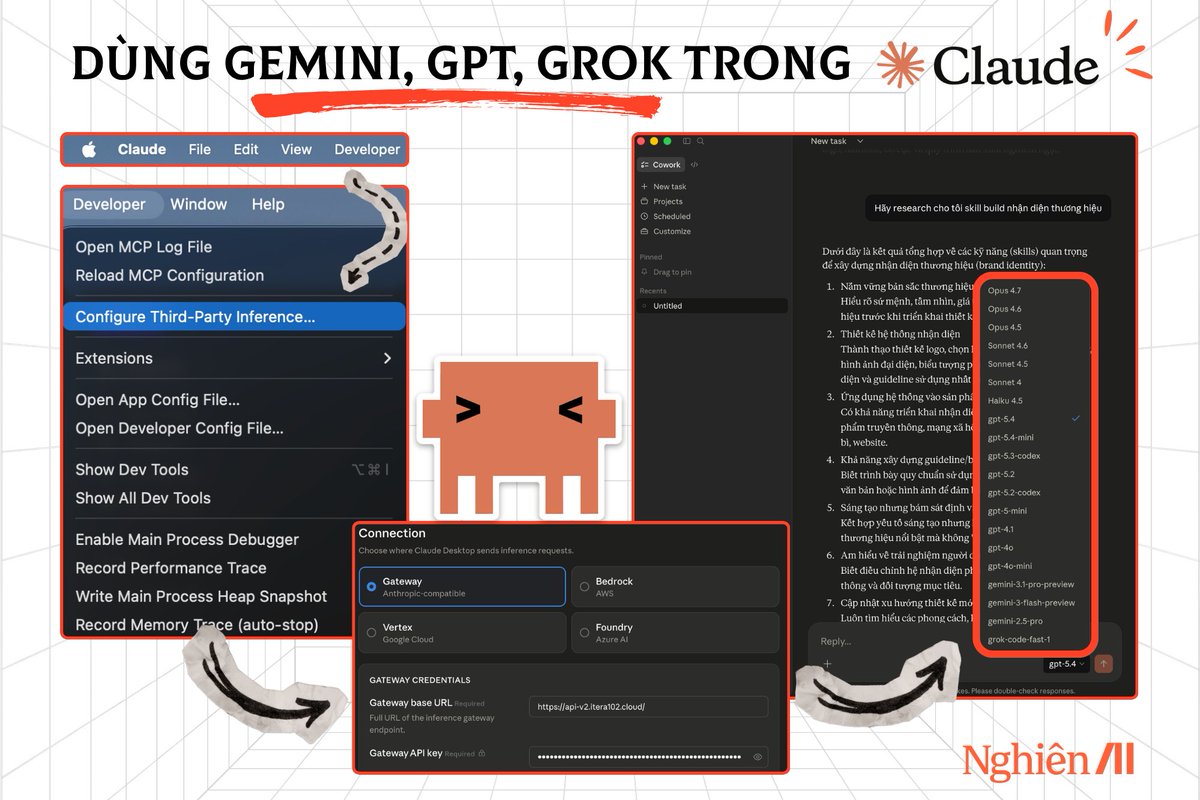

💯 Anthropic thả cửa cho dùng Gemini, GPT, Grok trong Claude App!

Cách làm:

1. Vào Help → Troubleshooting → Enable developer mode để bật chế độ developer

2. Vào Configure third-party inference sau đó điền thông tin gateway của URL và API key của bên thứ 3 như Ollama, LiteLLM hoặc OpenRouter.

3. Bấm Apply Locally để nó restart là xong phim!

Công đức vô lượng luôn Claude ơiiii, tháng này có tiền đi ăn buffet lại rồi 😁

Trong group còn nhiều tips hay nữa, mời anh em join

😎 https://t.co/wOX7GsW3qv

Thay vì để AI đoán mò, bạn hãy yêu cầu AI hỏi bạn 100-200 câu hỏi trước khi build 💯

Chuyện là mình đang muốn build 1 mini-blog. Mình đã viết cả 1 trang giấy A4 để miêu tả những gì mình muốn và mình nghĩ là như vậy đã quá đủ để nó tự làm từ A đến Z để sáng mai là blog đã taa-daaa hoàn thành.

NHƯNG KHÔNG, mình vừa test thử GLM 5.1 và model này hỏi mình rất nhiều khoảng 30 câu hỏi như:

- Lưu database ở đâu?

- Dùng CMS nào?

- AI tự viết content hay bạn viết?

- Nếu AI viết fail thì làm gì?

Cho đến những câu hỏi phức tạp hơn như:

- Trang blog rebuild trong bao lâu?

- CMS webhook trigger khi nào?

... Mình mới nhận ra với một người vibecode tay ngang như mình thì 1 trang giấy A4 chỉ chỉ chứa 1% của thực sự những gì bạn cần miêu tả để AI làm ĐÚNG Ý bạn từ A đến Z.

Vì vậy, mình đã thay đổi lại cách làm, thay vì để nó tự đoán mò, mình yêu cầu nó hỏi mình thật nhiều câu hỏi, tính đến bây giờ đã gần 200 câu để đảm bảo nó viết plan trước khi build.

Tới lượt bạn thử đi, chắc chắn kết quả sẽ bất ngờ hơn rất nhiều 😁

[NÊN ĐỌC] Bài này không nói về hãng giày FOMO AI... mà nói về câu chuyện lớn hơn đằng sau!

Nguồn: Elad Gil - Doanh nhân với 305k follower trên X

Mời anh em join group @nghienaivn để xoá mù AI trong 2 tháng 💯

https://t.co/wOX7GsW3qv

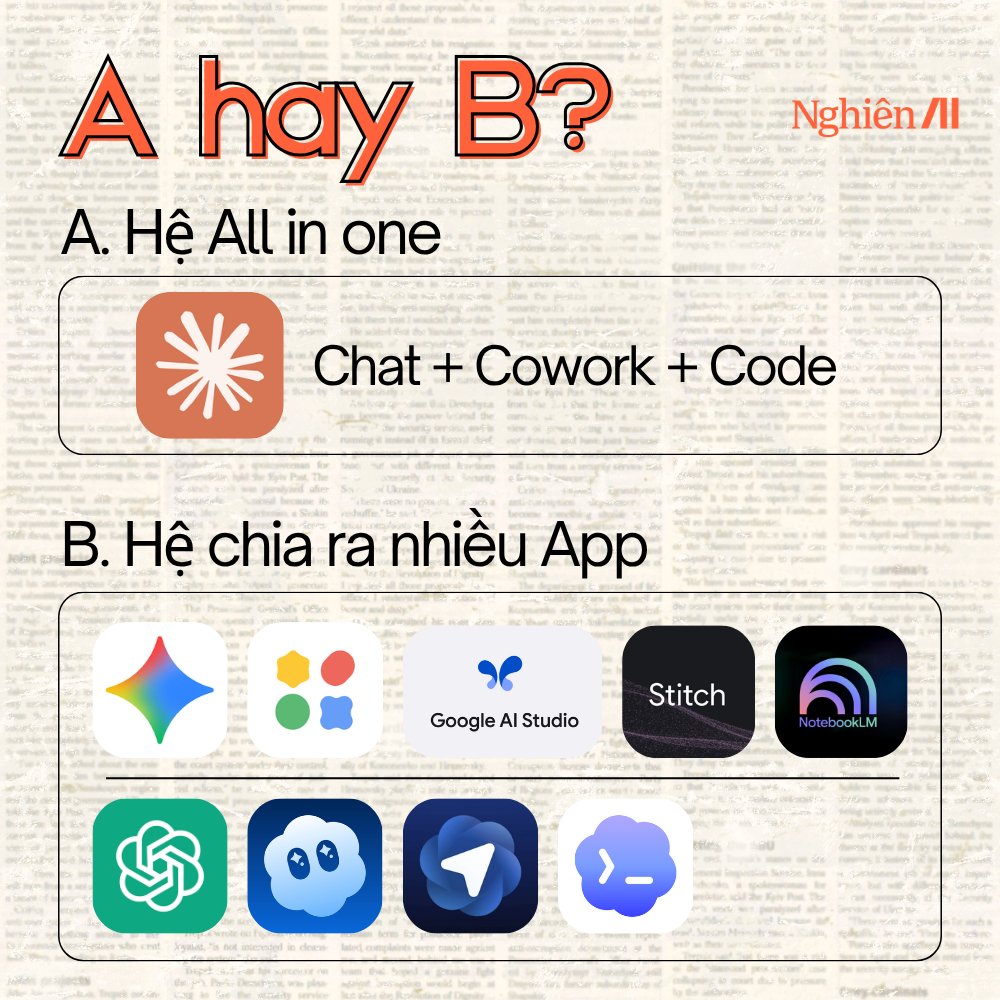

A hay B?

Mình thích cách thiết kế all-in-one của Claude hơn vì 2 lý do

1. Tất cả trong 1 thì rất tiện, ví dụ mình kết nối Claude với Google workspace thì các tính năng Chat, Cowork, Code đều có thể sử dụng được. Mình không cần kết nối lại khi sử dụng nhiều app khác nhau.

Còn bên hệ sinh thái OpenAI/ChatGPT đa dạng nhưng đôi khi lại bất tiện. Ví dụ như sáng nay ChatGPT vừa ra mắt bản Image khá xịn trong khi mình đang build app trên Codex. Vậy là phải miêu tả lại brand guideline cho cả 2 bên rồi mang file qua lại giữa 2 app chỉ để xử lý 1 vấn đề.

2. Lý do 2 còn quan trọng hơn là Claude dạy mình tư duy hệ thống, ko phải sử dụng app, follow app vì 1 tính năng mà dạy mình tư duy set-up file, sử dụng skill, tools,... từ đó giải quyết vấn đề tốt hơn. Đây cũng là cách Claude "mở cửa" đón sự đóng góp của cộng đồng giúp hệ sinh thái của họ mạnh hơn.

Quan trọng nhất là tính năng Cowork mình có chia sẻ sáng nay, nếu như Chat thì ai vào AI cũng đã phải dùng nhưng nhiêu người vẫn chỉ đứng ở đó, Code thì phần lớn là dev dùng thì Cowork chính là sản phẩm dành cho hành tỷ dân văn phòng và nó sẽ trở thành tiêu chuẩn mới như word, excel.

🛠️ Prompt tiếng Anh tiết kiệm hơn tiếng Việt bao nhiêu %?

- Tiếng Việt: “Viết một đoạn phân tích về cách AI giúp doanh nghiệp tăng năng suất”

- Tiếng Anh: “Write an analysis of how AI improves business productivity”

Cùng một ý, nhưng:

- Bản tiếng Việt thường ~18–22 tokens

- Bản tiếng Anh ~12–15 tokens

=> Tiết kiệm khoảng 25–30%

Lý do là

- Thứ nhất, tiếng Việt là đơn âm tiết. “năng suất” = 2 phần, “doanh nghiệp” = 2–3 phần. Tokenizer thường phải tách nhỏ từng mảnh → số token tăng lên.

Trong khi tiếng Anh “productivity”, “enterprise” thường được nén thành ít token hơn vì là từ ghép.

- Thứ hai, tiếng Việt có dấu. Những ký tự như “ă, â, ư…” khiến tokenizer khó match pattern tối ưu, nên phải chia nhỏ hơn để biểu diễn. → cùng một từ, tiếng Việt thường bị split nhiều hơn.

- Thứ ba, bias từ dữ liệu training. Phần lớn model được train mạnh trên tiếng Anh, nên tokenizer được tối ưu để “nén” tiếng Anh hiệu quả nhất. → tiếng Anh = ít token hơn cho cùng lượng thông tin

----

1 phút làm quen 😁

Thứ 7 tuần này @nghienaivn sẽ tổ chức buổi cafe “cai nghiện AI” ☕ để giúp mọi người không bị "lạc lối" với AI nữa.

Anh em có thể đăng ký ở đây https://t.co/rJgh07GozR

Đảm bảo có nhiều insights giá trị 👀

----

Nhìn cái hình này, nếu chỉ hiểu là “cách AI chia nhỏ dữ liệu thành token” thì hơi nông. Thứ nó đang lộ ra thực ra là một thứ quan trọng hơn nhiều: mọi loại dữ liệu cuối cùng đều bị ép về token, nhưng mỗi loại có một “tỷ giá” khác nhau.

Text là rẻ nhất. Một câu đơn giản chỉ vài token. Nhưng sang image, một tấm 512x512 đã thành 256 token. Audio 1 giây ~50 token. Video 1 giây nhảy lên ~750 token.

Lý do là LLM không “hiểu” ảnh hay video như con người. Nó chỉ hiểu chuỗi token. Với text, bản thân ngôn ngữ đã là một dạng nén thông tin rồi. Nhưng với ảnh, audio, video, model buộc phải băm nhỏ dữ liệu thô thành từng mảnh để xử lý.

Từ góc nhìn này, giới hạn của AI không nằm ở model trước, mà nằm ở token budget. Khi hiểu được phần này, bạn sẽ không chỉ prompt tốt hơn, quản lý context windows tốt hơn mà còn tiết kiệm hơn khi nghĩ đến bài toán business.

#NghiênAI @nghienaivn

🛠️ Prompt tiếng Anh tiết kiệm hơn tiếng Việt bao nhiêu %?

- Tiếng Việt: “Viết một đoạn phân tích về cách AI giúp doanh nghiệp tăng năng suất”

- Tiếng Anh: “Write an analysis of how AI improves business productivity”

Cùng một ý, nhưng:

- Bản tiếng Việt thường ~18–22 tokens

- Bản tiếng Anh ~12–15 tokens

=> Tiết kiệm khoảng 25–30%

Lý do là

- Thứ nhất, tiếng Việt là đơn âm tiết. “năng suất” = 2 phần, “doanh nghiệp” = 2–3 phần. Tokenizer thường phải tách nhỏ từng mảnh → số token tăng lên.

Trong khi tiếng Anh “productivity”, “enterprise” thường được nén thành ít token hơn vì là từ ghép.

- Thứ hai, tiếng Việt có dấu. Những ký tự như “ă, â, ư…” khiến tokenizer khó match pattern tối ưu, nên phải chia nhỏ hơn để biểu diễn. → cùng một từ, tiếng Việt thường bị split nhiều hơn.

- Thứ ba, bias từ dữ liệu training. Phần lớn model được train mạnh trên tiếng Anh, nên tokenizer được tối ưu để “nén” tiếng Anh hiệu quả nhất. → tiếng Anh = ít token hơn cho cùng lượng thông tin

Nhìn cái hình này, nếu chỉ hiểu là “cách AI chia nhỏ dữ liệu thành token” thì hơi nông. Thứ nó đang lộ ra thực ra là một thứ quan trọng hơn nhiều: mọi loại dữ liệu cuối cùng đều bị ép về token, nhưng mỗi loại có một “tỷ giá” khác nhau.

Text là rẻ nhất. Một câu đơn giản chỉ vài token. Nhưng sang image, một tấm 512x512 đã thành 256 token. Audio 1 giây ~50 token. Video 1 giây nhảy lên ~750 token.

Lý do là LLM không “hiểu” ảnh hay video như con người. Nó chỉ hiểu chuỗi token. Với text, bản thân ngôn ngữ đã là một dạng nén thông tin rồi. Nhưng với ảnh, audio, video, model buộc phải băm nhỏ dữ liệu thô thành từng mảnh để xử lý.

Từ góc nhìn này, giới hạn của AI không nằm ở model trước, mà nằm ở token budget. Khi hiểu được phần này, bạn sẽ không chỉ prompt tốt hơn, quản lý context windows tốt hơn mà còn tiết kiệm hơn khi nghĩ đến bài toán business.

#NghiênAI @nghienaivn

Tin này của @nghienaivn chấn động quá =)))

🔥 Cowork sẽ là tính năng thay đổi hành vi hàng triệu dân văn phòng

Cowork vẫn là tính năng cực kỳ giá trị của Claude mà chưa được khai phá hết - đây cũng là tệp user đông nhất mà các công ty AI muốn nhắm đến.

Tính năng Chat thì đã rất nhiều người biết đến nó, bây giờ search trên Google cũng đã có Gemini Chat.

Tính năng Code thì lại dành cho dân dev chuyên nhiều hơn, giao diện, cách sử dụng cũng khó tiếp cực.

Còn Cowork sẽ là tính năng thực sự thay đổi hành vi của hàng tỷ dân văn phòng trên khắp thế giới. Đây sẽ là tiêu chuẩn mới giống như biết Word, Excel những năm trước.

Nếu biết dùng Cowork, chắc chắn năng suất của bạn sẽ tăng ít nhất gấp đôi, chất lượng & kết quả sẽ tăng dần trong 3 tháng. Và quan trọng là từ tư duy của một người làm chuyên môn, bạn sẽ có tư duy cao hơn của một quản lý nhưng được đòn bẩy sức mạnh từ chuyên môn của mình.

Hiện tại mình đang dùng Cowork cho việc gì?

- Quản lý kiến thức nhưng không phải 10-20 bài viết lưu trên Drive như trước đây mà là 100-200 bài được lưu trong hệ thống RAG để luôn trích xuất được dữ liệu cho mình làm research.

- Mình có thể scale được mọi thứ quy mô hơn, ví dụ như cần tải transcript của 100 video YouTube bây giờ chỉ mất 10 phút trong khi trước đây mất cả ngày.

Mình sẽ chia sẻ về chủ đề này trong buổi cafe Cà phê “cai...nghiện AI” ☕ Vì không gian có giới hạn nên nếu anh em tham gia được thì đăng ký giúp mình ở đây nha https://t.co/rJgh07GozR

- 8h-11h sáng Thứ 7, 25/04

- Địa điểm: Tụi mình sẽ gửi địa điểm sau (TPHCM)

- Free - tự pay cafe

Hẹn gặp lại anh em @nghienaivn sáng thứ 7 tuần này nha 😁

Test thử tính năng Image của ChatGPT, ổn app quá 🔥

ChatGPT tranh thủ thu hút lại khách hàng trong khi Claude liên tục tăng giá 🫶

Ảnh trái được gen từ ảnh gốc bên phải.

Từ từ thôi Claude ớiiii

✅ Claude Code

✅ Claude Cowork

✅ Claude Design

🔲 Claude Marketing

🔲 Claude Sales

🔲 Claude Finance

🔲 Claude HR

🔲 Claude Operations

🔲 Claude Customer

Nếu anh chị đã "lỡ" đò với AI, thui thì mình join event thứ 7 tuần này, hứa giúp mọi người không bị bơ vơ nữa 😁

Nghiên AI Meetup - Cà phê “cai nghiện AI” ☕

https://t.co/rJgh07GozR

Nguồn: CodeByNZ

(MEET-UP) HAY LÀ TỤI MÌNH CAI... NGHIỆN AI 😁

Anh em có đang nghiện AI quá mức khum?

Mở máy ra là chat từ sáng tới tối, làm nhanh hơn thật nhưng cũng dễ bị kẹt trong cái loop của mình, ít nói chuyện ngoài đời hơn.

Nên tụi mình làm Unplugged #1 – “Cà Phê Cai Nghiện AI”☕

Tắt màn hình một chút, ra ngoài ngồi nói chuyện với nhau. Không slide, không ai đứng dạy, chỉ chia sẻ thật: AI đang giúp gì, workflow nào đang chạy được, và gặp đúng người cùng hệ.

8h-11h sáng Thứ 7, 25/04

Địa điểm: Tụi mình sẽ gửi địa điểm sau

Free - tự pay cafe

Vì không gian quan có giới hạn, nếu anh em thấy hợp vibe thì đăng ký ở đây nha 👋

https://t.co/rJgh07GozR

"Nghiện nhưng không nặng = Nghiên AI"

#NghienAI #offline