💯 [Giải ngố] RAG có thực sự thần kỳ không mà ai cũng tung hô?

RAG (Retrieval-Augmented Generation) đang là công nghệ xuất hiện khắp nơi trong AI doanh nghiệp, từ chatbot đọc PDF cho tới AI kết nối Notion, CRM hay dữ liệu nội bộ.

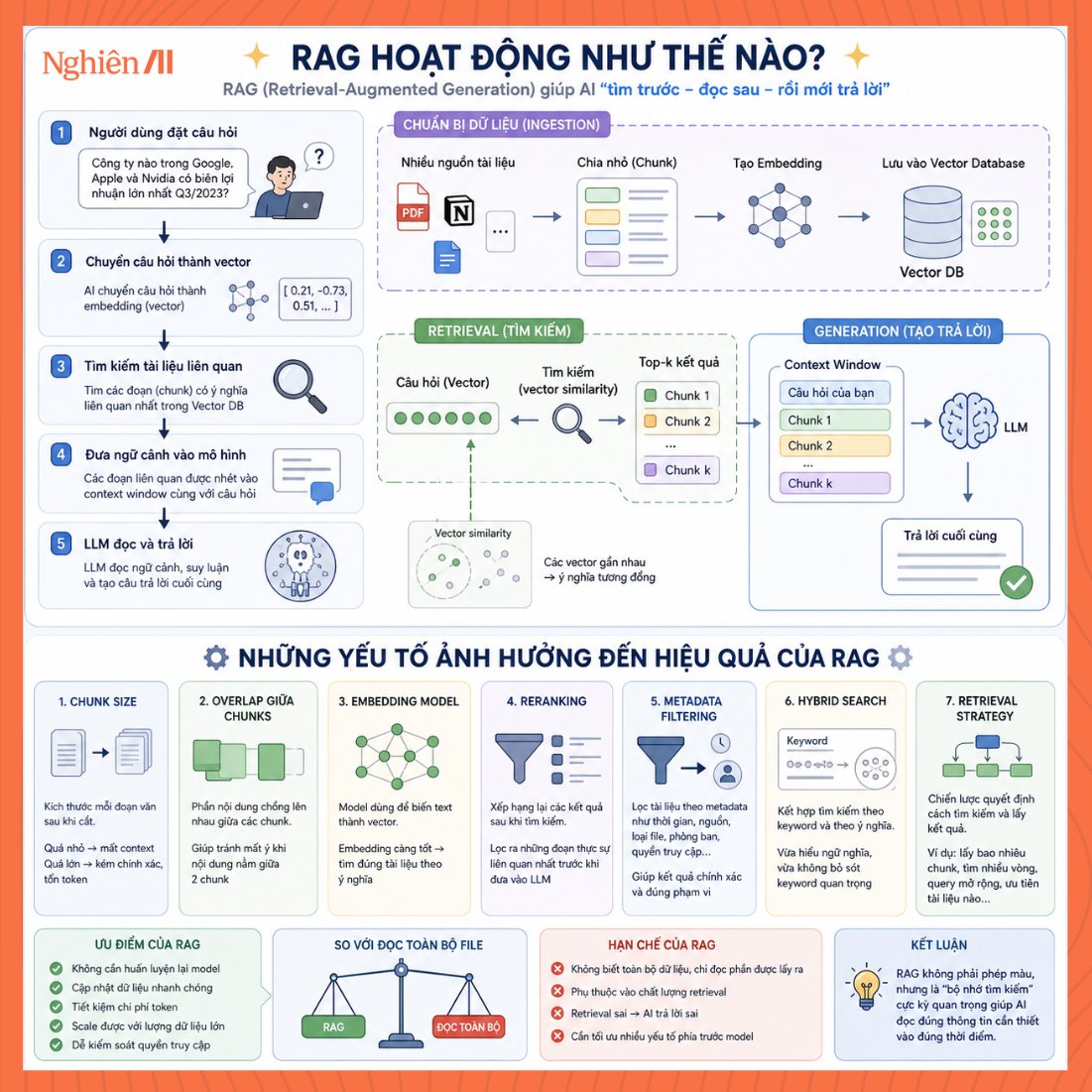

Nhưng thực ra RAG không làm AI “thông minh hơn thần kỳ”. Nó đơn giản là cơ chế giúp AI “search trước rồi mới đọc”.

Bình thường, các model như ChatGPT chỉ trả lời dựa trên dữ liệu đã được train sẵn. Nó không tự biết file PDF mới upload hay tài liệu nội bộ công ty. RAG giải quyết chuyện đó bằng cách cắt tài liệu thành nhiều đoạn nhỏ, biến chúng thành embedding vectors rồi lưu vào vector database. Khi user hỏi, hệ thống sẽ search những đoạn liên quan nhất rồi đưa vào context window để AI đọc trước khi trả lời.

Điểm quan trọng là AI không đọc toàn bộ dữ liệu. Nó chỉ đọc vài đoạn được retrieval system lấy ra tại thời điểm query.

Đây là lý do RAG cực kỳ quan trọng trong thực tế. Vì context window hiện tại vẫn hữu hạn và token rất đắt.

Một công ty có thể có hàng triệu ticket support, hàng chục nghìn file PDF hay hàng GB dữ liệu nội bộ nên gần như không thể nhét toàn bộ vào context mỗi lần AI trả lời.

RAG hoạt động như một lớp “bộ nhớ tìm kiếm”, giúp AI chỉ đọc đúng phần cần thiết. Nhưng đây cũng là điểm yếu lớn nhất của nó. Nếu retrieval search sai tài liệu, thiếu context hoặc lấy chưa đủ thông tin thì AI vẫn trả lời sai dù model phía dưới rất mạnh.

Đó là lý do phần khó nhất của RAG thường nằm ở retrieval engine phía trước model, chứ không phải bản thân LLM.

Để RAG hoạt động hiệu quả, phía dưới phải tối ưu rất nhiều thứ:

- Chunk Size: Kích thước mỗi đoạn text sau khi cắt. Chunk quá nhỏ thì mất context, chunk quá lớn thì retrieval kém chính xác và tốn token hơn.

- Overlap Between Chunks: Phần nội dung chồng lên nhau giữa các chunk để tránh mất ý khi một đoạn văn nằm giữa ranh giới hai chunk.

- Embedding Model: Model dùng để biến text thành vector ý nghĩa. Embedding càng tốt thì khả năng tìm đúng tài liệu càng cao.

- Reranking: Sau khi retrieval lấy ra nhiều đoạn liên quan, reranker sẽ chấm điểm lại để chọn vài đoạn thực sự phù hợp nhất trước khi đưa vào LLM.

- Metadata Filtering: Lọc tài liệu theo thời gian, phòng ban, loại file, user hoặc quyền truy cập để retrieval chính xác hơn.

- Hybrid Search: Kết hợp semantic search và keyword search để vừa hiểu nghĩa vừa không bỏ sót exact keyword quan trọng.

- Retrieval Strategy: Logic quyết định cách search, lấy bao nhiêu chunk, search bao nhiêu vòng hay có dùng agent query expansion hay không.

Thực tế hiện nay, nhiều AI doanh nghiệp mạnh hơn không hẳn vì model tốt hơn. Họ mạnh hơn vì retrieval system, context engineering và orchestration phía sau tốt hơn.

RAG không phải phép màu. Nó là bài toán “đưa đúng context vào đúng thời điểm” và đó đang là một trong những khó khăn lớn nhất của AI hiện đại.

Follow @nghienaivn để update kiến thức liên tục về AI

🟠 https://t.co/wOX7GsW3qv

---

From X

Disclaimer: The above content reflects only the author's opinion and does not represent any stance of CoinNX, nor does it constitute any investment advice related to CoinNX.