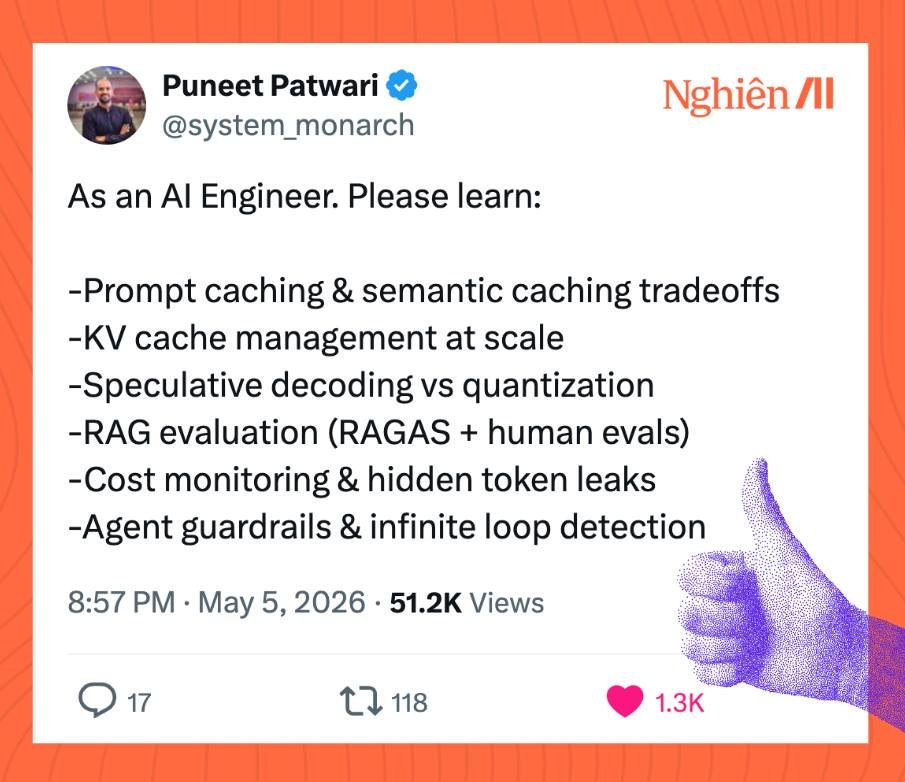

✍️ Nếu muốn trở thành kỹ sư AI, hãy học những thứ sau

Theo lời khuyên của Kỹ sư Phần mềm tại Atlassian

🟠 Prompt caching & semantic caching

Khi build AI production thật sự, vấn đề lớn nhất thường không còn là “model có thông minh không”, mà là hệ thống có chạy đủ nhanh và đủ rẻ không.

Đó là lý do caching (lưu sẵn kết quả cũ) gần như bắt buộc. Prompt caching hoạt động kiểu: prompt giống hệt → trả lại kết quả cũ thay vì gọi model suy nghĩ lại từ đầu.

Semantic caching nâng cấp hơn một chút. Hệ thống sẽ cố hiểu xem hai câu có cùng ý nghĩa hay không. Ví dụ: “RAG là gì?” và “RAG hoạt động như thế nào?" có thể dùng chung cache dù câu chữ khác nhau.

Điểm đánh đổi nằm ở chỗ cache càng mạnh thì càng nhanh và rẻ, nhưng cũng càng dễ lấy nhầm ngữ cảnh hoặc dùng lại output cũ không còn phù hợp.

🟠 KV cache management

KV cache (bộ nhớ tạm của model) là một trong những lý do ChatGPT trả lời nhanh như hiện tại.

Khi AI đang generate từng token, nó không muốn đọc lại toàn bộ context từ đầu mỗi lần viết thêm một chữ mới. KV cache giúp model lưu sẵn “trạng thái suy nghĩ” trước đó để tái sử dụng.

Hiểu đơn giản giống như bạn đang đọc sách và dùng bookmark thay vì mỗi lần đọc tiếp lại mở từ trang 1.

Nhưng KV cache rất tốn VRAM. Context càng dài thì cache càng lớn. Khi có hàng triệu user dùng cùng lúc, việc quản lý memory (bộ nhớ), batching (gom request) và GPU efficiency (hiệu suất GPU) trở thành bài toán cực khó.

🟠 Speculative decoding vs quantization

Đây là hai kỹ thuật tối ưu inference (quá trình AI tạo output) phổ biến nhất hiện nay.

Speculative decoding hoạt động kiểu model nhỏ “viết nháp” trước, sau đó model lớn chỉ cần kiểm tra lại thay vì tự suy nghĩ toàn bộ từ đầu. Giống như intern làm draft rồi senior review lại.

Quantization là kỹ thuật nén model để giảm VRAM và chạy nhanh hơn trên GPU yếu hoặc máy local.

Tradeoff là model càng nhẹ thì càng rẻ và dễ deploy, nhưng đôi khi reasoning (khả năng suy luận) và chất lượng output cũng giảm theo.

Còn tiếp 👇

From X

Disclaimer: The above content reflects only the author's opinion and does not represent any stance of CoinNX, nor does it constitute any investment advice related to CoinNX.