迟到两个多月的 DeepSeek V4 终于来了,要不是为了做中国芯片的适配,这要是放两个月前发布那是绝对的炸裂,放现在虽然出彩,但还没到惊艳的地步。

我把 DeepSeek 58 页的技术报告啃完,结论先放在最前面:

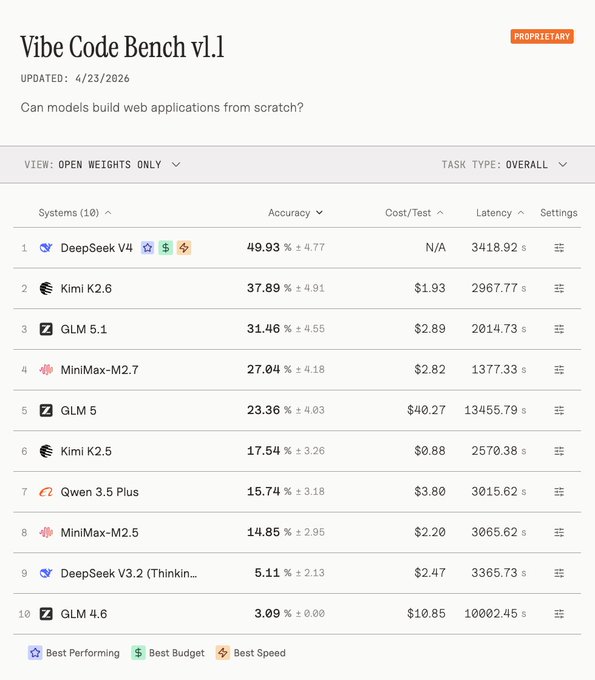

这一代 V4 不是小修小补,是开源模型阵营的一次代差升级。 1.6T 总参数、49B 激活、原生 1M token 上下文,单 token 推理 FLOPs 比 V3.2 降 73%,KV cache 降 90%。在自家给的对比表里,Kimi 2.6(K2.6)和 GLM 5.1 大部分知识与推理任务被拉开 10~20 个百分点,Codeforces 直接干到 3206 分(人类排名第 23)。

DeepSeek 这次选的开源对手是 K2.6 Thinking 和 GLM-5.1 Thinking,大概和 Qwen 3.6 max 预览版同一强度,但 DeepSeek 定价更低,Qwen 尴尬了,榜单还没坐稳两天。

From X

Disclaimer: The above content reflects only the author's opinion and does not represent any stance of CoinNX, nor does it constitute any investment advice related to CoinNX.