Monad也接入了RWA生态,看了下这次的资产还是以货币基金和AAA级别的信贷产品为主,风险较低,适合稳定理财

Claude Mythos 架构被开源社区“逆向还原”了。

OpenMythos 基于公开论文和工程推演,尝试从第一性原理重构 Claude Mythos 的核心思路:循环深度 Transformer。

它最值得关注的地方,是把传统 Transformer 的“多层堆叠”改成“同一层循环计算”。模型先通过 Prelude 编码输入,再让 Recurrent Block 反复推理 N 次,最后由 Coda 完成输出。这样做的潜在优势是:参数更省、推理深度更灵活,也更接近一种“在隐藏空间里反复思考”的机制。

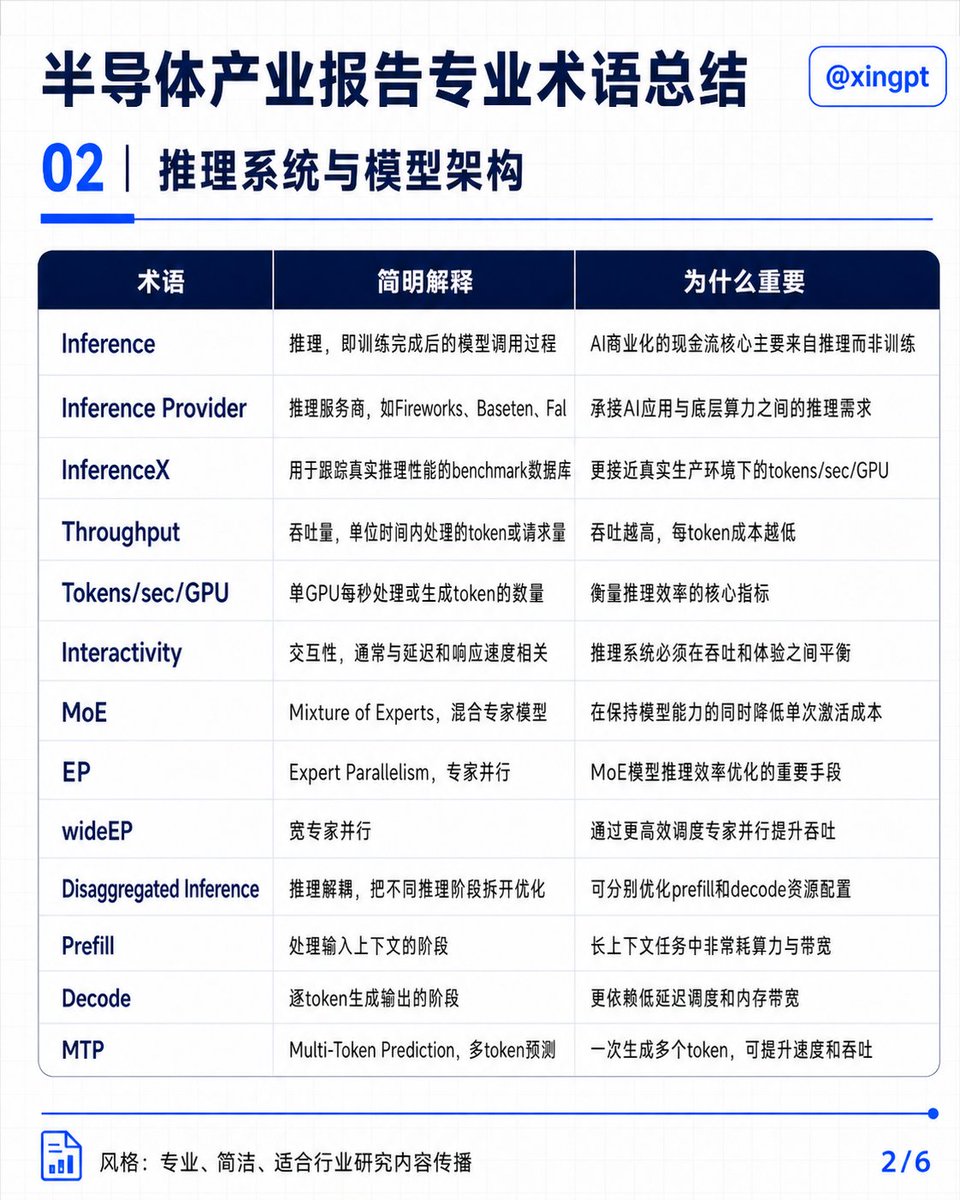

项目里还引入了输入注入、防漂移、ACT halting、MoE、GQA/MLA 等设计,用来增强稳定性、领域扩展能力和推理效率。

当然,这不是 Anthropic 官方公布的 Claude 架构,也不能等同于真正的 Claude Mythos。它更像是一份开源社区基于公开研究做出的可运行假设。

但它的价值在于:让下一代推理模型的架构讨论,从概念猜测走向可复现代码。

GitHub:kyegomez/OpenMythos

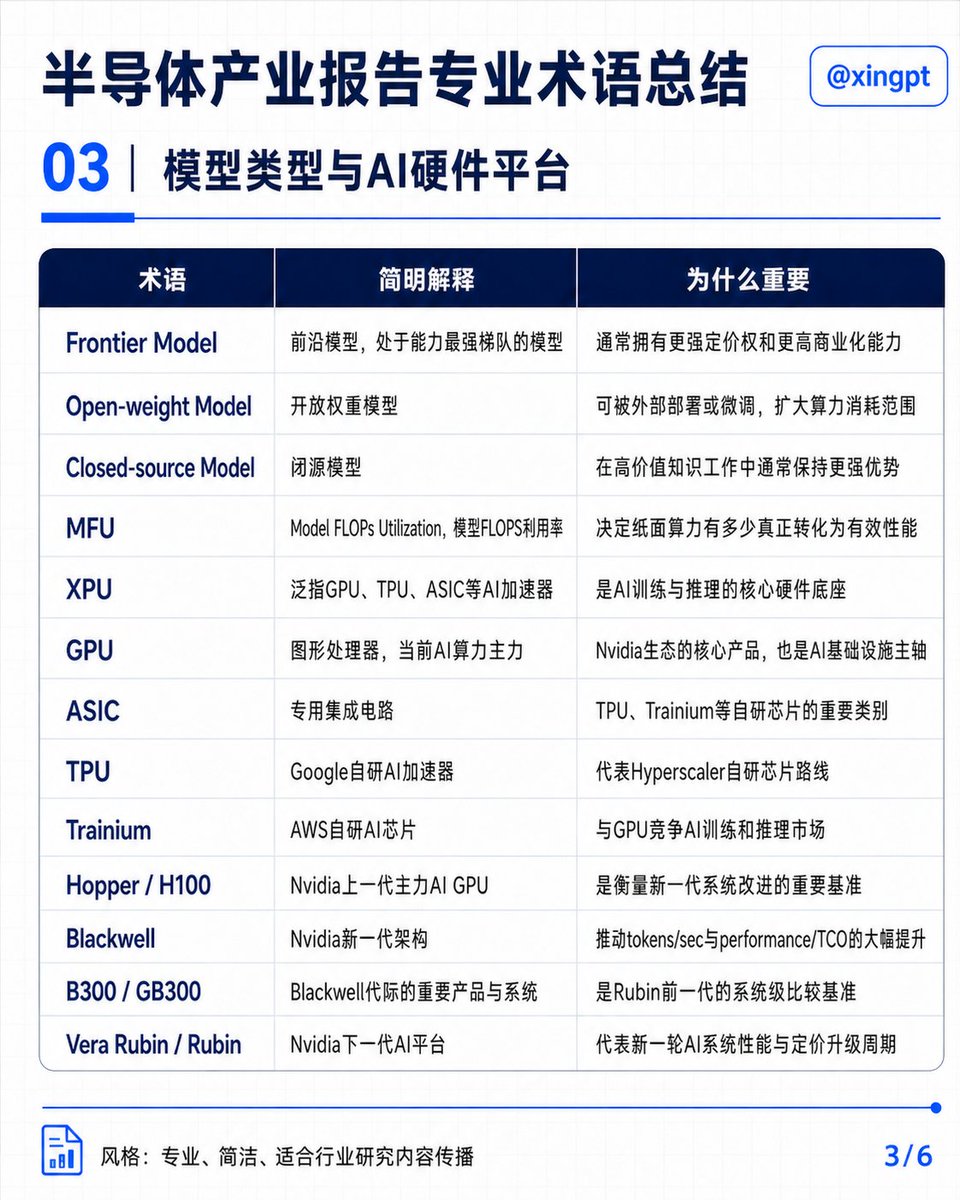

Google TPU Shift 正在把 AI 算力产业链重新拉开。

这轮变化的重点是 Google 自研 TPU 带来的系统级需求扩散,受益环节从芯片设计,延伸到先进封装、HBM、光互联、OCS、供电、散热、连接器和云 CPU 架构。

ASIC 设计 $AVGO

先进制程与封装:$TSM 、$AMKR

HBM 与 AI 存储:$MU、$SNDK、Samsung、SK Hynix

光模块与高速互联:$AAOI、$MRVL、$CRDO

OCS 光路交换:$COHR、$LITE、$FN

高密度供电:$MPWR、$AEIS、$VICR

液冷、配电与热管理:$VRT、$MOD、$NVT

高速线缆与连接器:$APH、$TEL、$GLW

云 CPU 架构:$ARM

Google TPU 的核心看点,是从单芯片性能竞争,走向系统级算力效率竞争。Virgo 网络、Apollo OCS、800G/1.6T 光模块、CoWoS、HBM 和数据中心功率密度,都会成为产业链新的增量来源。

后续重点盯五个节点:

1)Google TPU 出货是否上修

2)$AVGO AI 收入是否继续超预期

3)$TSM CoWoS 产能是否缓解

4)HBM 价格与客户认证

5)800G / 1.6T 光模块订单兑现

Google TPU 扩张的投资机会,已经从 $AVGO、$TSM,延伸到光互联、供电、散热、连接器和 HBM 等被算力密度推升的环节。

两张图看懂Google TPU 产业链:

1)TPU 8 首次分拆为训练 8t 与推理 8i,Google 开始按场景重构 AI 芯片路线。

2)Virgo 网络把单 fabric 连接规模推到 134,000+ 颗 TPU,带宽 47 Pb/s,延迟下降约 40%,光互联价值被明显放大。

3)Broadcom 仍是核心受益方,训练 TPU 8t、交换 ASIC 与整机硅含量带来高弹性,2026 年 Google+Anthropic 定制 AI 硅收入预计达 210 亿美元。

4)最大约束在 TSMC CoWoS 与 HBM。2026 年 CoWoS 需求 450–500 万,供给约 365 万,缺口 20–27%,Google TPU 目标也从 4M 下调至约 3M。

5)光模块、先进封装、HBM、定制 ASIC,是这轮 Google TPU 扩张最核心的产业链主线。

【全文都损伤的前额叶,这个skill帮你 47 天完成修复】

你是不是三页书都看不完就要摸手机,刷短视频,看股票行情?

这有可能是你的前额叶“受损”了。

"前额叶损伤"不是真的脑损伤,而是一种比喻,具体表现为:

- 思考被不断跳转、切断,难以深入一个问题的核心

- 注意力变得短暂、碎片化,只能以秒计算

- 读完一本书、看一部完整电影变得困难

- 需要高频刺激才能维持运转,普通事情(读书、散步、发呆)变得无聊

改变的原因是我停止相信自己能和一套精密设计的劫持系统对抗。

所以我建了一个Skill来修复这个状况:Prefrontal Habit 。

核心很简单:

这个系统的哲学是习惯越少越好。两周内同时不超过两个新习惯。做到了才加新的。做不到就降低目标,而不是硬撑。

如果你也觉得"前额叶损伤"说的就是自己,这个工具不能治愈你,但能让你看见自己的模式,并在偏离时把你温柔地拉回来。

从一个习惯开始。这就是全部的秘密。